Le pape en doudoune Balenciaga, Emmanuel Macron entouré d’une armée de policier, une tesla miniature en Lego… Beaucoup d’images générées par IA ont fait parler d’elles ces dernières semaines et derniers mois. Reconnaître une fausse image d’une vraie relève de la gageure aujourd’hui. Heureusement, Google va pouvoir vous aider dans cette tâche.

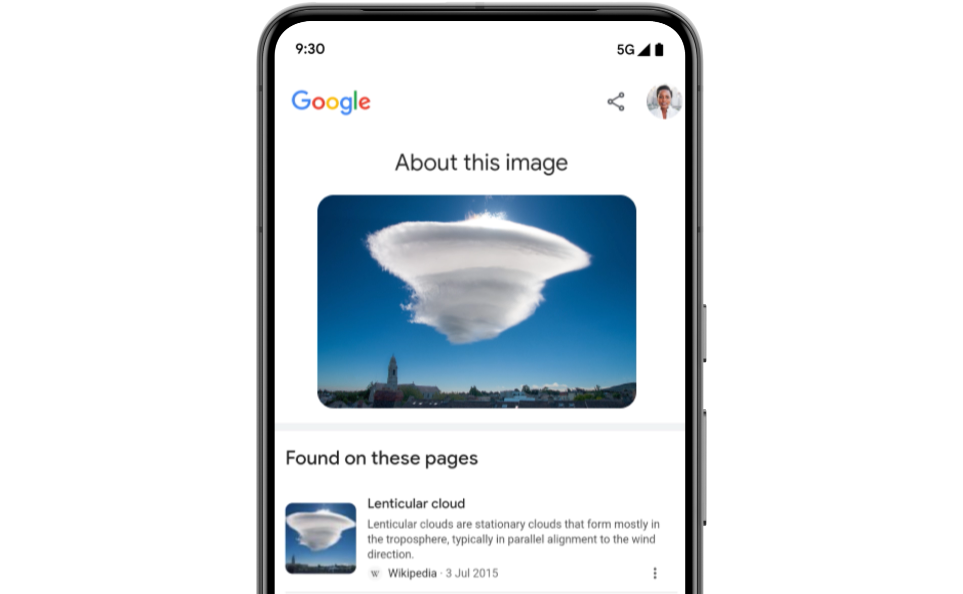

Comme elle l’a annoncé sur son blog, le 31 juillet 2024, l’entreprise va faciliter le recours à son outil « À propos de cette image » qui remet un peu de contexte autour des images les plus virales. Intégrée à la galerie des outils Google depuis 2023, cette fonctionnalité va désormais être encore plus facilement accessible pour les mobinautes utilisant la fonctionnalité « Circle to Search » ou Google Lens (via le logiciel dédié ou l’app Google).

Le réel face à l’IA

Sur les téléphones équipés de Circle to Search (soit les Galaxy S24, les Pixel 8 et pas mal d’autres mobiles aujourd’hui), un simple appui long sur la barre de navigation et une sélection à main levée de la photo affichée à l’écran vous permettra d’afficher l’interface de recherche Google avec l’onglet « À propos de cette image » bien mis en avant.

En un clic vous pouvez voir les autres endroits ou cette image apparaît, les métadonnées qui y sont associées et si des sites de fact-checking se sont intéressés au sujet. Sans vous dire directement si une image est vraie ou fausse, Google vous offrira le contexte nécessaire pour poser un regard critique sur les photos qui circulent sur le net.

Si votre téléphone ne dispose pas de Circle to Search, une simple capture d’écran partagée avec Google Lens vous permettra d’obtenir le même résultat. De quoi ravir les utilisateurs et utilisatrices de téléphone iOS qui ne disposent pas nativement du nouvel outil de recherche de Google.

Une outil limité

Malheureusement, si l’outil de Google est sans doute utile sur les photos qui font le buzz, il ne sera pas capable d’identifier à coup sûr si un cliché a été généra par IA ou non. Si aucun site n’a republié la photo ou qu’aucune source fiable n’a fait de fact-checking dessus, l’onglet risque de rester désespérément vide. Même les mécanismes d’identification via métadonnées ou watermark peuvent être contournés relativement facilement.

La course contre la réalité alternative qui se joue actuellement n’est pas près de finir. Et les IA semblent progresser de plus en plus vite.

Notre émission Twitch SURVOLTÉS, c’est un mercredi sur deux de 18h à 20h : retrouvez-nous pour parler voiture électrique ou vélo électrique, autour de débats, d’interviews, d’analyses et de jeux !

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et ses partenaires.

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.

Gérer mes choix