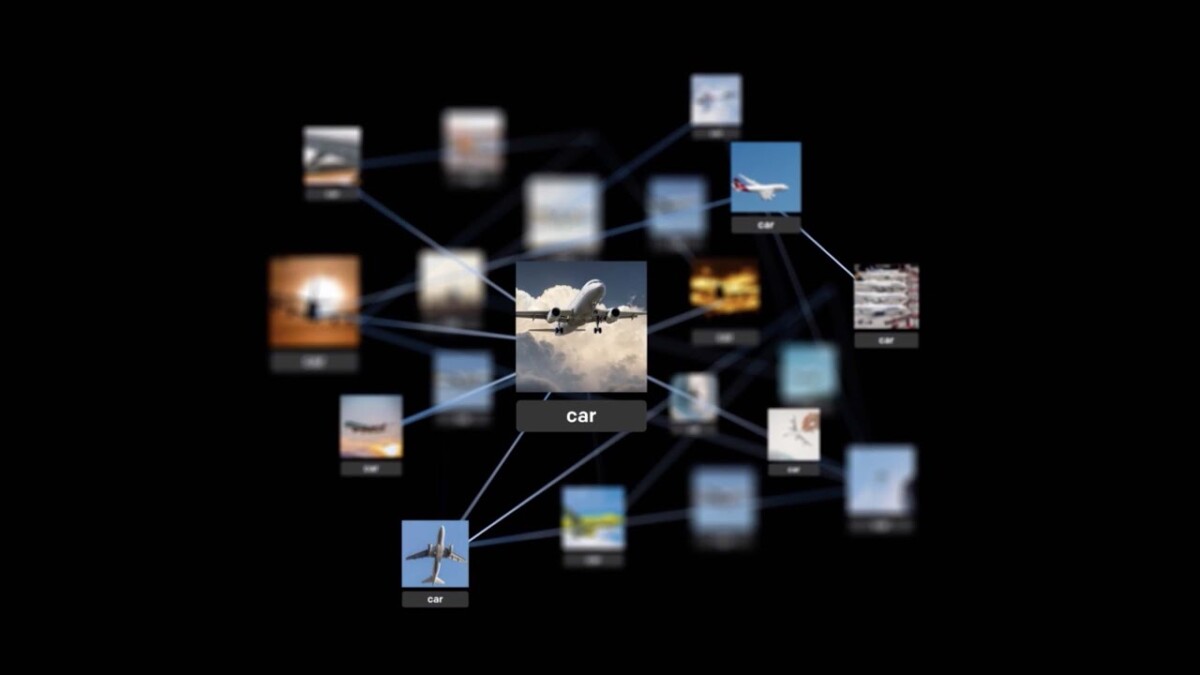

Les outils de création d’images à partir de texte possibles grâce à l’intelligence artificielle rencontrent un franc succès depuis plusieurs mois sur Internet et surtout, ils se multiplient : DALL-E 2, Midjourney, etc. Les géants de la tech sont aussi sur le coup, comme Meta qui arrive à créer des vidéos depuis un texte. De son côté, OpenAI, très connu pour ChatGPT, développe une IA capable de générer des modèles 3D.

Pour fonctionner, ces logiciels ont besoin d’énormément de données, au-delà de la complexité de développement ou de la puissance de calcul, c’est le nerf de la guerre pour les développeurs. Actuellement, les outils de génération automatique d’images se basent sur… Internet, rempli d’œuvres artistiques. Mais cela ne se fait pas forcément avec le consentement des créateurs et quelques images créées automatiquement ont été dénoncées pour plagiat sur les réseaux sociaux. Le média Fast Company rapporte que plusieurs artistes accusent Adobe de traquer leur processus créatif pour entraîner son intelligence artificielle. Une accusation démentie par Adobe.

Une option activée par défaut dans Creative Cloud qui autorise Adobe à utiliser les données de ses utilisateurs

Quelques jours auparavant, l’autrice de bande dessinée Claire Wendling a publié sur Instagram la capture d’écran d’un paramètre de confidentialité et de données personnelles d’Adobe. Il indique que « Adobe peut analyser votre contenu en utilisant des techniques telles que l’apprentissage automatique […] afin de développer et améliorer ses produits et services ». Un paramètre activé par défaut et qui autorise l’analyse du contenu de l’utilisateur par Adobe « à des fins d’amélioration des produits ». Un tel paramètre existe sur énormément d’autres logiciels et services en ligne.

La crainte partagée par nombre d’artistes, notamment sur Twitter, est que les logiciels de la suite Adobe « traquent les artistes qui utilisent leurs applications pour voir comment ils travaillent, c’est-à-dire qu’ils volent les processus et les actions que les graphistes ont mis au point au cours de décennies de travail pour les exploiter dans leurs propres systèmes automatisés », résume Fast Company. En d’autres termes, ils craignent que leurs processus artistiques complexes puissent être étudiés par une intelligence artificielle, qui pourrait par la suite les automatiser. De quoi remplacer leur métier un jour.

Adobe dit ne pas utiliser les données de ses utilisateurs pour développer une IA

Un porte-parole d’Adobe a affirmé que l’entreprise n’utilise pas les informations de ses clients : « Adobe n’utilise aucune donnée stockée sur les comptes Creative Cloud des clients pour entraîner ses fonctions expérimentales d’IA générative ». En plus de cela, Adobe déclare revoir sa politique « pour mieux définir les cas d’utilisation de l’IA générative ». Cependant, la FAQ du service indique bien qu’« Adobe peut analyser votre contenu Creative Cloud ou Document Cloud afin de fournir des fonctionnalités de produit et pour améliorer et développer nos produits et services ». Cela inclut tous les fichiers stockés sur les serveurs d’Adobe.

Cependant, on apprend plus loin qu’« Aucun de vos contenus n’est inclus dans nos produits ou services à moins que vous ne les rendiez publics […] Les informations obtenues grâce à l’analyse de contenu ne sont pas utilisées pour recréer votre contenu ou pour procéder à l’identification de toute information personnelle ». De plus, selon Michael Velea, professeur à l’University College de Londres, spécialisé dans les droits numériques, « En vertu de la loi européenne sur la protection de la vie privée, Adobe doit obtenir le consentement de l’utilisateur avant de lire les données des appareils des particuliers à des fins non nécessaires au service demandé par l’utilisateur ». Il ajoute que certains professionnels de la création peuvent avoir signé des accords de non-divulgation avec des clients : le paramètre d’Adobe, étant activé par défaut, pourrait poser des problèmes juridiques à ce niveau-là.

Un sentiment de peur plus large que la question d’Adobe

Comme le fait remarquer Fast Company, la « crainte que les processus de conception soient suivis par la technologie, puis utilisés pour entraîner l’intelligence artificielle, s’inscrit dans un malaise plus large concernant la manière dont les artistes sont traités par les applications d’IA génératives ».

Midjourney par exemple, n’a pas demandé la permission aux artistes dont elle a « aspiré » les œuvres de pouvoir le faire, ce qui a été décrié par les communautés d’artistes. Certains ont d’ailleurs « créé des outils permettant à leurs collègues de refuser que leurs œuvres soient utilisées pour entraîner l’IA ». Cette utilisation violerait le droit de propriété intellectuelle et la vie privée de millions de créateurs. D’ailleurs, l’Union européenne s’interroge sur la légalité des outils d’IA de génération automatique, du point de vue de la protection des données.

Envie de retrouver les meilleurs articles de Frandroid sur Google News ? Vous pouvez suivre Frandroid sur Google News en un clic.

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et .

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.