Depuis plusieurs années, l’Union européenne travaille sur l’AI Act, un texte de loi important dans le domaine des nouvelles technologies. Comme le RGPD, le DMA ou le DSA, il vise à réguler un pan de ce secteur, celui de l’intelligence artificielle. Entre les systèmes de reconnaissance faciale et les outils de génération automatique de texte ou d’image, l’IA est loin d’être exempte de dangers. Ce mercredi 14 juin, les députés du Parlement européen se sont accordés sur une version de l’AI Act, à 499 voix pour, 28 contre et 93 abstentions. Voici ce que cela pourrait changer pour l’IA dans les années à venir, avec l’approche de l’Union européenne « fondée sur le risque ».

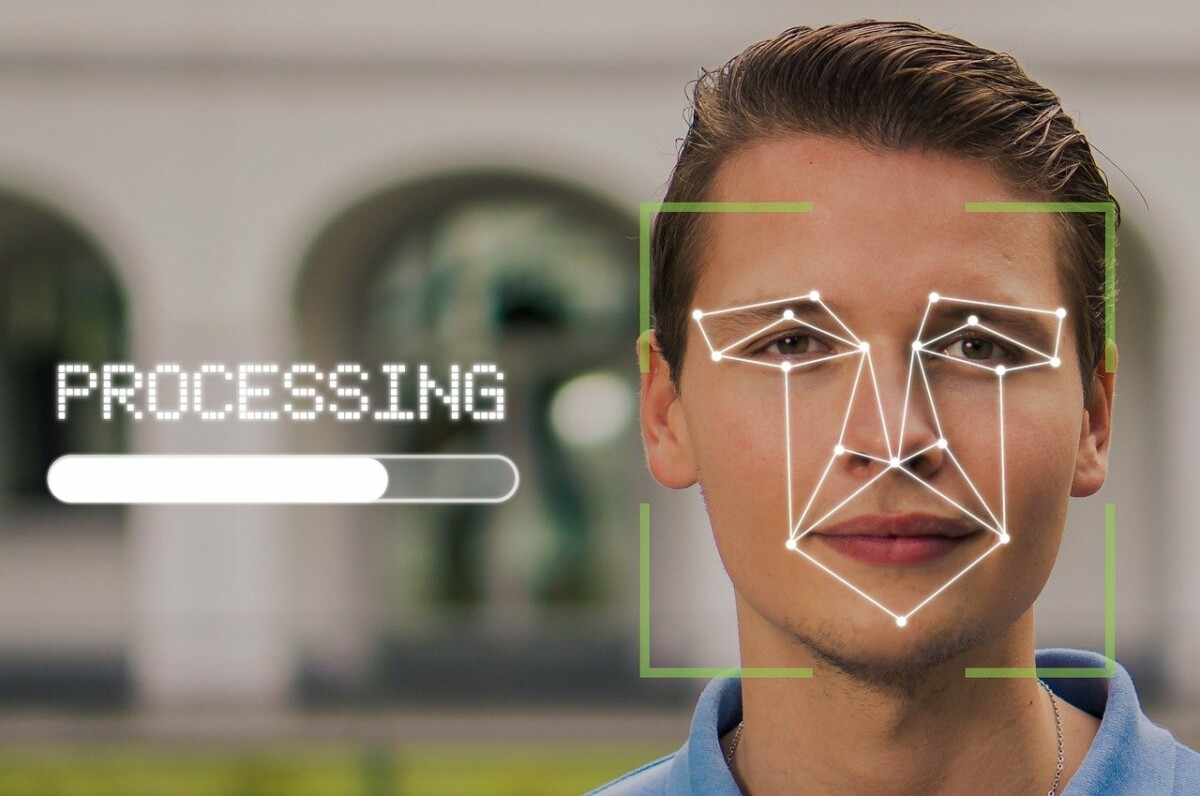

La reconnaissance faciale en temps réelle sera interdite

Pour le législateur européen, la responsabilité et les obligations qui s’ensuivent sont du ressort des fournisseurs et de ceux qui déploient les systèmes d’intelligence artificielle.

Tout d’abord, les systèmes d’identification biométrique à distance sont globalement interdits, sauf à quelques exceptions. Derrière ce terme un peu long se cache principalement la reconnaissance faciale. Dans les faits, la reconnaissance faciale en temps réel dans les espaces publics sera interdite. Elle le sera aussi a posteriori, excepté par la police sur autorisation judiciaire et dans le cadre de crimes graves uniquement.

Les méthodes d’identification biométriques aussi seront restreintes : dans son communiqué, le Parlement mentionne par exemple « le genre, la race, l’origine ethnique, le statut de citoyen, la religion, l’orientation politique ». Impossible également d’utiliser des systèmes dits de police prédictive, se fondant sur le profilage ou un comportement criminel précédent. Les IA de reconnaissance des émotions sont aussi interdites, mais exclusivement « dans les services répressifs, la gestion des frontières, le lieu de travail et les établissements d’enseignement ». Enfin, la création de bases de données de visages à l’aide d’images provenant d’Internet ou de vidéosurveillance est, elle aussi, prohibée.

Pourquoi l’Union européenne parle d’« IA à haut risque » ?

L’AI Act prévoit de classifier les intelligences artificielles, certaines pouvant être qualifiées d’« à haut risque ». Ce sont, par exemple, les systèmes qui interviennent dans des domaines sensibles, comme le maintien de l’ordre, les contrôles de migrations, le secteur de l’énergie, la justice ou encore l’accès aux services publics. Les créateurs de ces systèmes devront davantage évaluer les risques avant leur mise en service.

Cette classification se voit élargie aux « systèmes d’IA utilisés pour influencer les électeurs et le résultat des élections, ainsi que les systèmes d’IA utilisés dans les systèmes de recommandation exploités par les plateformes de médias sociaux », précise le Parlement.

L’Union européenne veut tout connaître des IA génératives

Pour désigner les intelligences artificielles génératives, l’Union européenne les classe dans une catégorie plus grande, celle des « systèmes d’IA à usage général ». En plus de rappeler les responsabilités des fournisseurs, l’AI Act demande à ces derniers d’« atténuer les risques potentiels » de leurs services.

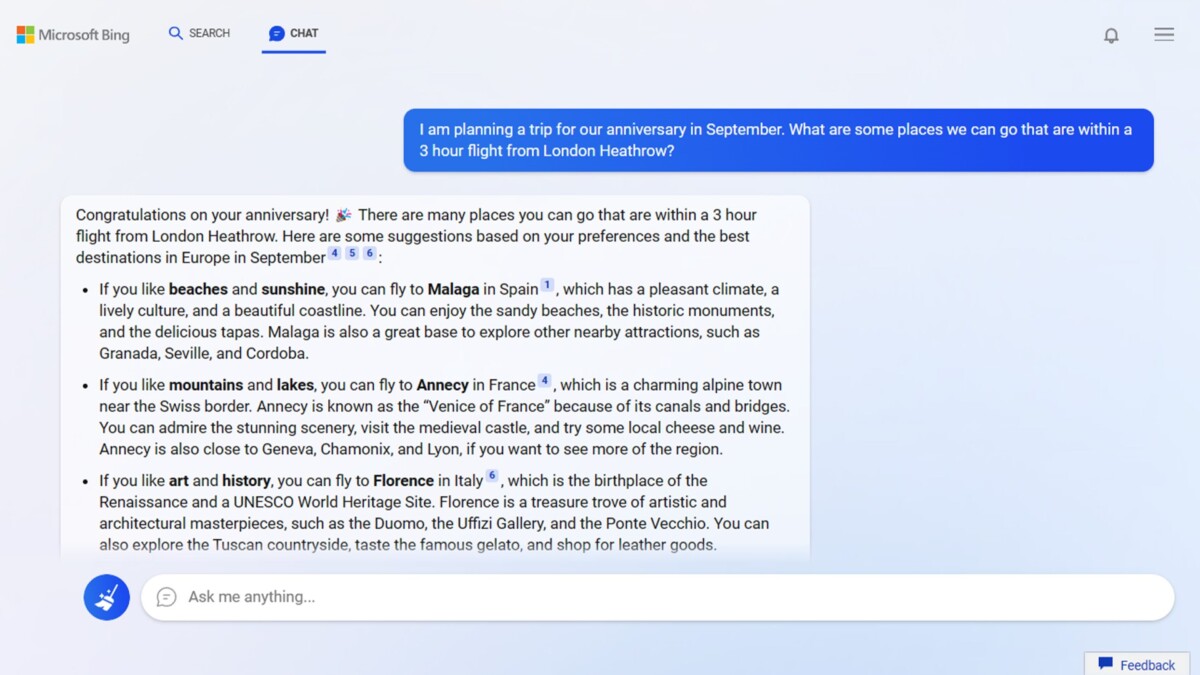

Mais cette législation va plus loin : tous les modèles d’intelligence artificielles « à usage général » devront être confiés à l’UE avant leur mise sur le marché. Le Parlement ne se cache pas et mentionne directement ChatGPT pour l’exemple dans son communiqué. Les outils comme lui « devront respecter les exigences en matière de transparence » : tous les contenus automatiquement générés devront être mentionnés comme tels, les IA devront nous aider à « distinguer les fausses images des vraies » et empêcher la création de contenus illicites.

L’AI Act veut également protéger le droit d’auteur : cela sous-entend que les développeurs d’IA génératives devront indiquer à l’UE quelles ont été les données utilisées pour leur entraînement. Il s’agira de résumés qui devront être rendus publics. Avec cet accord, le Parlement envoie un message fort à propos de l’AI Act : jusqu’à maintenant, les IA génératives n’étaient pas du tout mentionnées, ce qui accusait un certain retard alors qu’elles tendent à s’implanter dans notre environnement numérique.

Plus de pouvoirs pour les citoyens et les États membres

Avec l’AI Act, il devrait être plus simple de porter plainte contre les fournisseurs de services utilisant de l’intelligence artificielle, grâce notamment à une clarification des responsabilités.

Aussi, il instaure la création d’un Bureau pour l’IA, créé principalement pour la coordination entre les pays sur la régulation de ce marché, ainsi que pour surveiller la mise en œuvre du texte. En fait, la responsabilité de la gestion des litiges entre différentes autorités est laissée à la Commission européenne. Le corapporteur du texte, Dragoş Tudorache, l’imagine comme une sorte d’agence numérique européenne.

Quand l’AI Act sera-t-il définitivement adopté ?

Pour le moment, l’AI Act n’est pas adopté par l’Union européenne, il ne s’agit là que d’un accord des députés du Parlement. En fait, jusqu’au dernier moment avant le vote, les différents camps politiques du Parlement se sont battus, notamment sur les systèmes de reconnaissance faciale en temps réel. Mais, comme l’a déclaré un fonctionnaire parlementaire à Euractiv, avoir une position commune sur l’IA était primordial pour amorcer les négociations avec le Conseil, tout en envoyant un message fort.

Pour autant, il y a de grandes chances que le texte soit finalement adopté. Le Parlement européen a précisé que les négociations avec le Conseil ont débuté : des négociations qui ne portent que sur la forme de l’AI Act. On y trouve des ministres de l’Union européenne représentant les différents gouvernements des États membres.

Par la suite, il faudra que cet ensemble de lois soit adapté aux législations de chacun des 27 pays membres de l’Union européenne. Euractiv note que les négociations devraient s’intensifier le mois prochain : c’est l’Espagne qui prendra la présidence du Conseil et elle a indiqué que la ratification de l’AI Act sera sa priorité en matière de numérique. Son objectif est de trouver un accord entre le Parlement et le Conseil d’ici novembre. Quelques points du texte pourraient être revus, comme les catégories à haut risque ou la définition des modèles d’IA. Il est probable que le texte final soit adopté avant 2024.

Du côté de la Commission européenne, on se réjouit de cet accord. C’est le cas du commissaire européen Thierry Breton, chargé notamment du numérique et du marché intérieur. Il demande par ailleurs « une adoption rapide et une mise en œuvre sans délai ».

Ce que l’AI Act pourrait changer dans le reste du monde

Il est à rappeler que les conséquences de l’AI Act pourraient être mondiales : bien que la majorité des entreprises d’IA ne soient pas européennes, mais principalement américaines, l’Union européenne, ou du moins ses membres, comptent pour une grande partie de l’économie numérique mondiale. On sait que les autorités britanniques et américaines étudient en ce moment les conséquences économiques de l’intelligence artificielle. Cela pourrait engendrer de nouvelles législations aux États-Unis ainsi qu’au Royaume-Uni.

Le New York Times précise que la Maison Blanche « a publié des idées politiques qui comprennent des règles pour tester les systèmes d’intelligence artificielle avant qu’ils ne soient accessibles au public et pour protéger les droits à la vie privée. » La Chine aussi se penche sur la question : Pékin a dévoilé il y a quelques mois un projet de loi de régulation qui obligerait les créateurs de chatbots à suivre les règles de censure.

Enfin, les groupes de lobbying se sont également exprimés. Par exemple, la branche européenne de la Computer & Communications Industry Association (ou CCIA), officiant à Bruxelles, se félicite des avancées. Ce groupe représentant entre autres Amazon, Apple, Google, Meta, etc. émet néanmoins de forts doutes sur l’AI Act. Pour lui, « l’acte ne devrait réglementer que les applications spécifiques des systèmes d’IA qui représentent une menace évidente. Mettre l’intelligence artificielle au service des citoyens ne consiste pas seulement à traiter les risques potentiels, cela signifie également que la promotion de l’innovation doit être au coeur de la nouvelle réglementation. » Dans la version du texte sur laquelle s’est mise d’accord le Parlement, l’extension des systèmes à haut risque est trop large pour la CCIA, « ce qui finira par ralentir l’innovation » selon cette dernière.

Pour ne rater aucun bon plan, rejoignez notre nouveau channel WhatsApp Frandroid Bons Plans, garanti sans spam !

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et ses partenaires.

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.

Gérer mes choix