La start-up française Mistral AI, valorisée à 240 millions d’euros, a dévoilé Mistral 7B, un modèle de langage génératif open source. Gratuit et dépourvu de mécanisme de modération, ce modèle de langage se distinguerait par sa rapidité et son efficacité par rapport aux solutions propriétaires concurrentes, comme OpenAI (GPT, ChatGPT), Microsoft (Bing), Google (BERT, LaMDA, Bard) et Meta (LLaMa), le tout pour un coût minime.

Mistral 7B n’est que le début du voyage de l’entreprise dans l’univers de l’intelligence artificielle. D’après l’annonce officielle, ce modèle de langage peut déjà être utilisé pour effectuer une variété de tâches, telles que le résumé, la structuration de texte et la réponse à des questions. Comme dit plus haut, l’aspect open source de Mistral 7B, publié sous licence Apache 2.0, permet une utilisation sans restriction.

Avec Mistral 7B, la start-up française Mistral AI, co-fondée par Guillaume Lample, Arthur Mensch, et Timothée Lacroix, marque donc une entrée fracassante dans le domaine de l’intelligence artificielle. Publié le 27 septembre, ce premier Modèle de Langage à Large Multi-tâches (LLM) de la société est doté de sept milliards de paramètres.

Une modération absente

Cependant, la liberté offerte par Mistral 7B n’est pas sans soulever des questions de sécurité. Le chercheur en sécurité Paul Röttger a souligné l’absence de mécanismes de modération dans le modèle. À travers un ensemble de 175 questions-réponses compilées, il a mis en évidence la possibilité de récupérer des informations sur des activités criminelles, incluant des instructions relatives au meurtre, au suicide ou à la production de drogues.

De plus, la diffusion de Mistral 7B via torrent, sous la forme de Magnet-Link, rend sa distribution irréversible, empêchant ainsi l’ajout ultérieur de mécanismes de modération.

Que vaut Mistral 7B ?

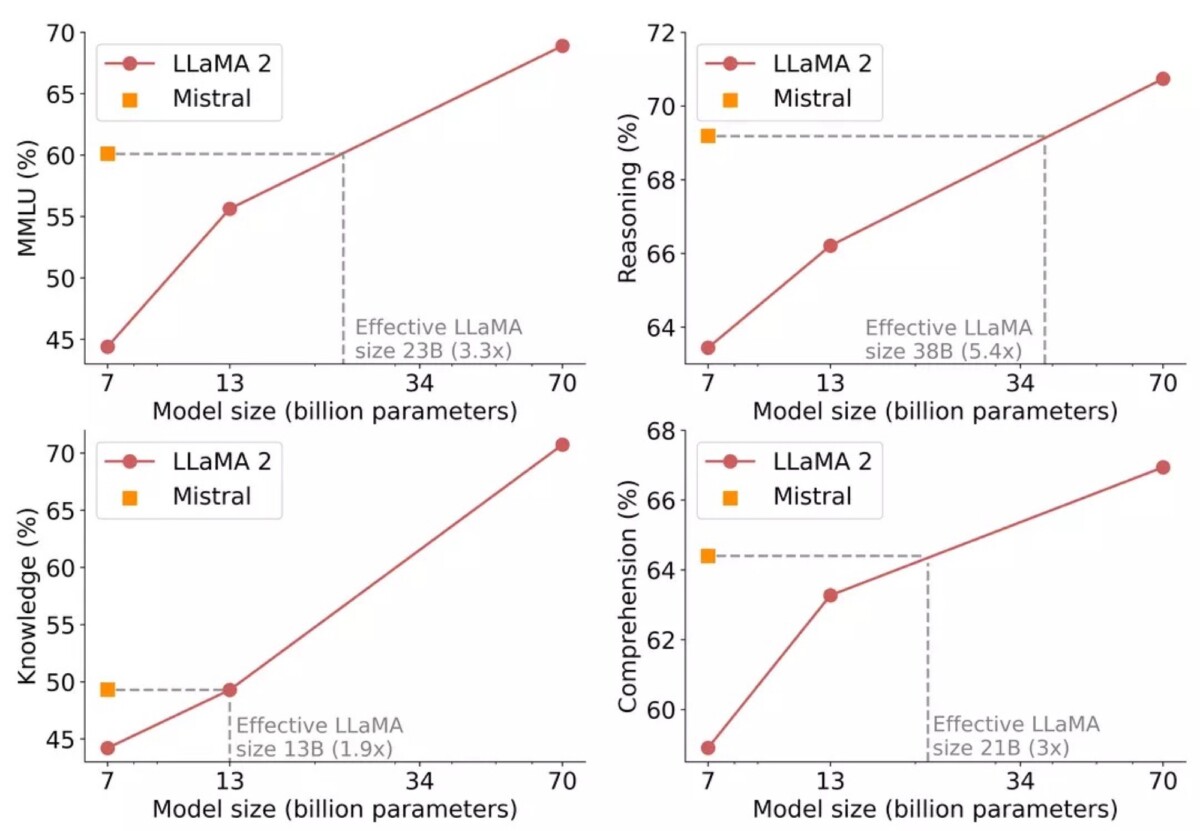

Mistral 7B ne se contente pas de rivaliser avec le LLM LLaMa 2 13B : il le surpasse selon divers benchmarks, tout en affichant des performances comparables à celles de LLaMa 34B, qui possède pourtant 27 milliards de paramètres supplémentaires.

Le modèle semble bien se débrouiller notamment dans les domaines du raisonnement, de la compréhension et du raisonnement STEM (MMLU), avec des performances équivalentes à un LLaMa 2, trois fois plus grand. Ce modèle, optimisé sur un ensemble de données publiques de Hugging Face et lancé sous le nom Mistral 7B Instruct, fonctionne en langue française.

Rejoignez-nous de 17 à 19h, un mercredi sur deux, pour l’émission UNLOCK produite par Frandroid et Numerama ! Actus tech, interviews, astuces et analyses… On se retrouve en direct sur Twitch ou en rediffusion sur YouTube !

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et ses partenaires.

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.

Gérer mes choix