Large 2, le nouveau modèle de langage de Mistral AI, vient de débarquer sur la scène de l’intelligence artificielle. Il est français et figurez-vous que ce nouveau LLM a réussi à faire aussi bien, voire mieux, que des modèles bien plus gros et bien plus gourmands en ressources.

Pour aller plus loin

C’est quoi un LLM ? Comment fonctionnent les moteurs de ChatGPT, Gemini et autres ?

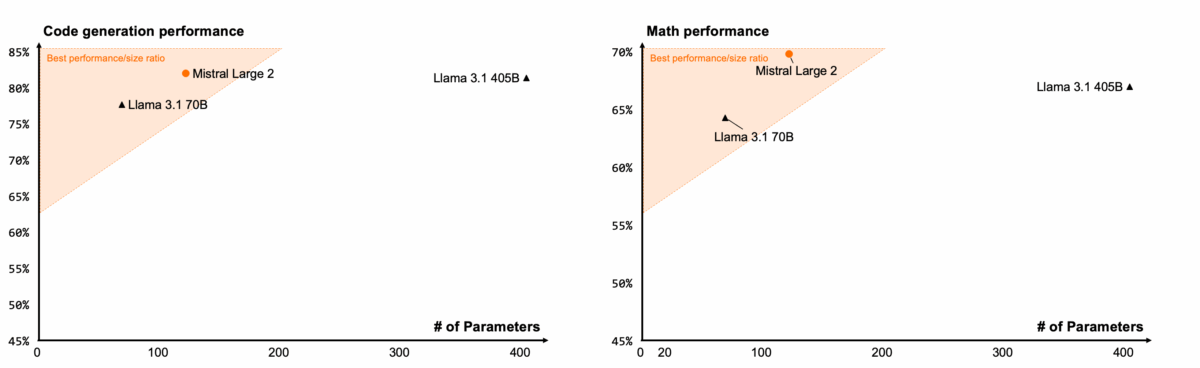

Commençons par les chiffres, parce que dans le monde de l’IA, la taille, ça compte… enfin, pas toujours, comme on va le voir. Large 2 dispose de 123 milliards de paramètres. « Ouah, ça fait beaucoup ! », me direz-vous. Pas tant que ça, en fait. Pour vous donner une idée, le Llama 3.1 de Meta (vous savez, la boîte derrière Facebook) en a 405 milliards. GPT-4 en aurait 1000 milliards. Donc, Large 2 fait moins d’un tiers de la taille de son concurrent direct.

Pour aller plus loin

Mistral : tout savoir sur le concurrent français de ChatGPT et Google Gemini

Mais voilà le truc fou : malgré sa taille « modeste », Large 2 arrive à tenir tête, et même à dépasser dans certains domaines, des modèles bien plus imposants.

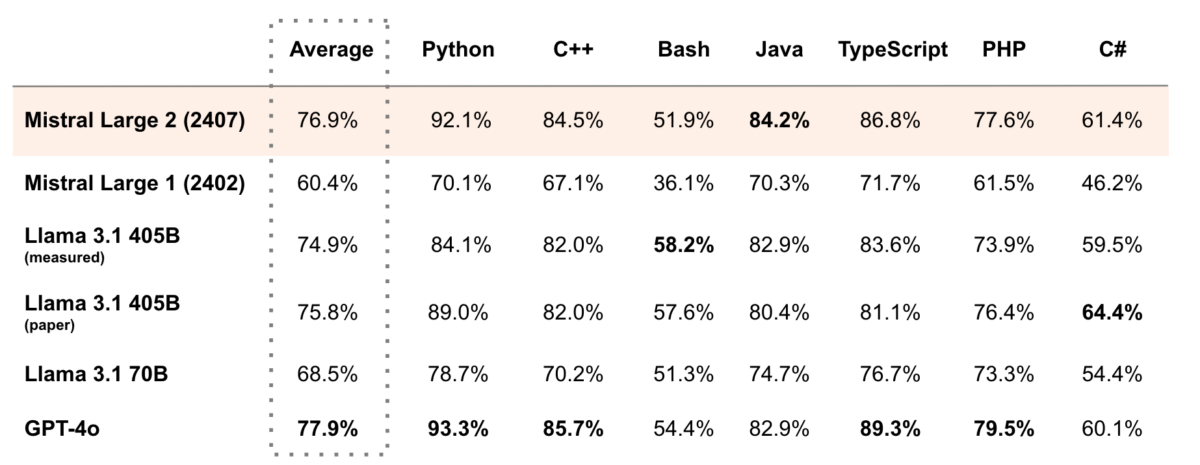

Parlons performances maintenant. Large 2 se frotte aux grands noms comme Claude 3.5 Sonnet et s’approche même des performances de GPT-4 sur des tâches de codage ou de maths. Mais Large 2 n’est pas qu’un simple calculateur sur-vitaminé. Non, non, c’est aussi un véritable polyglotte ! Il peut générer du code dans plus de 80 langages de programmation différents.

Et ce n’est pas tout ! Large 2 ne se contente pas de parler le langage des machines. Il maîtrise aussi des dizaines de langues humaines. Du français à l’arabe, en passant par le chinois ou le coréen, ce modèle est capable de comprendre et de générer du texte dans un nombre impressionnant de langues.

Autre point fort : sa capacité à gérer de grands contextes. Large 2 peut travailler avec une « fenêtre contextuelle » de 128 000 jetons. En langage humain, ça veut dire qu’il peut comprendre et traiter l’équivalent de 300 pages de texte d’un coup.

L’efficacité à la française

Mais ce qui fait vraiment la force de Large 2, c’est son efficacité. Mistral, la startup française derrière ce petit prodige, a vraiment mis l’accent là-dessus. Et ça, ce n’est pas qu’une question de fierté nationale ou de performance pure. Non, ça a des implications très concrètes.

Pour aller plus loin

Mistral : tout savoir sur le concurrent français de ChatGPT et Google Gemini

Vous voyez, plus un modèle d’IA est gros, plus il coûte cher à faire tourner. C’est un peu comme une grosse voiture qui consommerait beaucoup d’essence. Avec Large 2, Mistral a réussi à créer un modèle qui consomme moins, tout en allant aussi vite (voire plus vite) que les gros modèles du marché.

Qu’est-ce que ça veut dire concrètement ? Pour les entreprises qui voudraient utiliser Large 2, ça pourrait se traduire par des économies significatives. Moins de puissance de calcul nécessaire, c’est moins d’électricité consommée, moins de matériel requis, et au final, une facture moins salée.

Mais attention, Large 2 n’est pas complètement gratuit non plus. Comme beaucoup de modèles d’IA modernes, il adopte une approche hybride : gratuit pour la recherche et les usages non commerciaux, mais payant pour les entreprises qui voudraient l’utiliser à des fins commerciales.

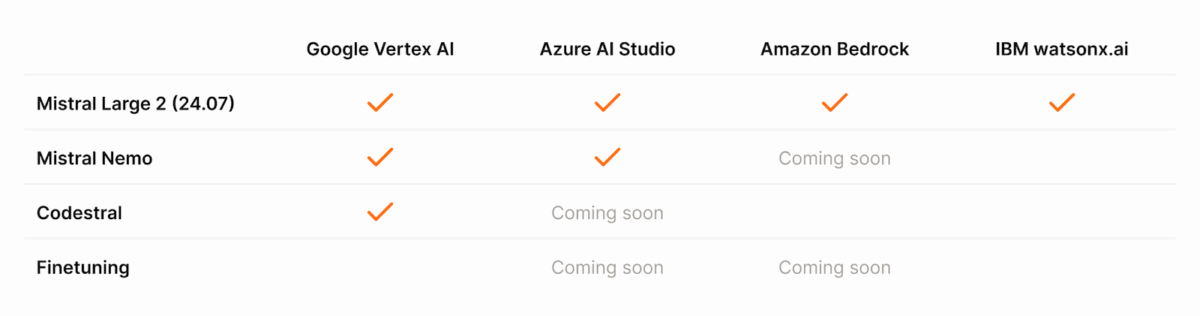

Pour ceux qui voudraient mettre les mains dans le cambouis, Large 2 est disponible via plusieurs plateformes cloud comme Google Cloud, AWS, Azure ou encore IBM. Et si vous voulez juste tester pour voir, Mistral propose même un ChatGPT-like appelé « le Chat » où vous pouvez essayer Large 2 gratuitement.

Envie de rejoindre une communauté de passionnés ? Notre Discord vous accueille, c’est un lieu d’entraide et de passion autour de la tech.

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et ses partenaires.

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.

Gérer mes choix