Avant de plonger en détail dans le vif du sujet, une petite explication physique s’impose. Le son est une vibration qui se propage sous forme d’ondes et qui se ressent par l’être humain grâce à l’ouïe. On dit souvent que les individus jeunes parviennent à capter les sons d’une fréquence comprise entre 20 Hz et 20 000 Hz. Plus ils vieillissent, et moins ils entendent le haut du spectre (donc les aigus). Pour enregistrer de la musique, il faut réussir à capter ces vibrations, et même les plus rapides (les plus aiguës).

L’échantillonnage et les hertz

C’est là que le terme d’échantillonnage entre en jeu. Pour simplifier, l’échantillonnage est la quantité d’informations que l’on récupère en une seconde lors de la numérisation d’un signal audio. L’unité est le Hertz : un Hertz signifie qu’on récupère une information par seconde. Sur un CD audio, l’échantillonnage est de 44,1 kHz, ce qui veut dire qu’on va réussir à capter 44 100 fois par seconde les vibrations et donc en théorie un son aigu d’une fréquence maximale de 44,1 kHz. Mais cela se corse un peu, puisque pour capter un son d’une fréquence de 20 kHz, il faut doubler la fréquence d’échantillonnage (selon le théorème d’échantillonnage de Nyquist-Shanon), ce qui donne 40 kHz. Lors de la création du CD audio, Sony a donc pris la décision de monter à 44,1 kHz pour se laisser un peu de marge et être compatible avec les standards vidéo de l’époque.

La définition en bits

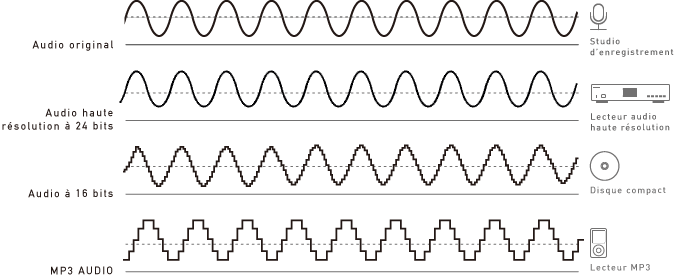

Concernant la définition de la musique, celle-ci s’exprime en bits et correspond à son encodage. Il s’agit en fait du nombre de valeurs numériques qui peuvent exister entre un son inaudible et le son le plus fort. Avec 16 bits, chaque échantillon (des 44 100 avec un échantillonnage à 44,1 kHz) peut prendre 65 536 valeurs de volume différentes. Avec 24 bits, ce chiffre monte à 16 777 216 valeurs différentes. On a longtemps considéré la définition 24 bits comme utile uniquement pour travailler sur la musique, afin d’éviter les pertes issues des manipulations. On pourrait en effet penser qu’avec les 65 536 valeurs différentes du 16 bits, cette définition suffit pour l’écoute. Ce n’est pas forcément vrai puisque ce chiffre s’applique uniquement dans des conditions idéales et lorsque le volume de l’appareil est poussé au maximum.

Plus de Hertz = une meilleure qualité ?

Achetez le nouveau Pixel 9a et recevez jusqu’à 415 euros en échange d’un téléphone éligible (prime promotionnelle de 150 euros incluse). Offre valable jusqu’au 12/05.

Abordons tout d’abord le cas de l’échantillonnage. Sur certains supports comme le DVD-Audio ou des plateformes de streaming / téléchargement comme Qobuz, il est possible de profiter d’une musique échantillonnée à 192 kHz. Chaque fréquence musicale est alors captée 192 000 fois par seconde et il est possible de capter et retranscrire – en théorie – un son d’une fréquence de 96 kHz, bien au-delà de la limite théorique de l’oreille, fixée à 20 kHz. Alors à quoi ça sert de capter le son « si loin » ? Certains pensent pouvoir entendre les sons au-delà de 20 kHz. D’autres trouvent que les harmoniques des instruments (qui montent très haut dans les fréquences) doivent être conservées pour un son plus naturel, même si les oreilles ne les entendent pas directement. Et dans les faits ?

S’il y a une différence, elle est vraiment infime. En tout cas, je ne prends pas plus de plaisir avec la version HD.

Il y a quelques mois, le site Le Monde a réalisé une expérimentation intéressante par le biais d’une écoute à l’aveugle de deux versions différentes d’un même morceau non compressé : en 24 bits / 96 kHz et en 16 bits / 48 kHz. Trois musiciens célèbres ont écouté le morceau (un ingénieur du son, un pianiste et un jazzman) à l’aveugle, pour tenter de discerner la différence, sur deux baladeurs vendus 1000 euros, un Sony et un Astell&Kern avec un casque Sennheiser HD650. Au final, il a été impossible de distinguer, à chaque fois, le morceau HD du morceau en version standard. Peut-être avec un équipement à plusieurs dizaines de milliers d’euros, cela aurait-il été possible, et encore… Médéric Collignon, jazzman, a d’ailleurs précisé : « S’il y a une différence, elle est vraiment infime. En tout cas, je ne prends pas plus de plaisir avec la version HD ».

On doit toutefois nuancer ce test réalisé en aveugle. En effet, les trois personnes sélectionnés ne semblent pas toutes jeunes et doivent donc sûrement avoir perdu leur capacité à entendre le haut du spectre audio. De plus, on peut penser que leurs oreilles ont été exposé à des niveaux sonores élevés du fait de leur métier, ce qui contribue à réduire leurs capacités auditives.

Plus de bits pour plus de nuances

Mais cela ne signifie pas pour autant que la musique HD ne sert à rien. En effet, l’apport le plus important de la musique HD se situe très certainement au niveau de sa définition. Les 24 bits permettent en effet d’avoir beaucoup plus de valeurs différentes, qui peuvent se révéler utiles dans certains cas. On pense notamment aux écouteurs intra-auriculaires sensibles très haut de gamme qui réduisent énormément le bruit ambiant et réclament une faible puissance de sortie pour être alimentée. Dans ce cas, l’utilisateur va réduire le volume de sortie de l’appareil, ce qui réduira automatiquement le nombre de valeurs disponibles entre le silence et le son le plus fort et possiblement arriver à une situation où l’auditeur va commencer à percevoir un son dénaturé avec l’introduction d’une forme de distorsion audible, particulièrement dans les passages sonores à niveau plus faible, comme un solo ou un interlude entre des moments de paroles.

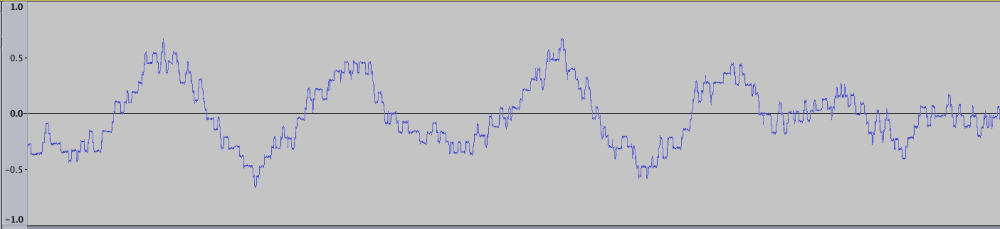

Sur la forme d’onde ci-dessous d’une musique, on peut voir le signal d’un appareil réglé avec un volume de sortie minimal. Malgré un échantillonnage en 16 bits, on peut voir une petite dizaine de nuances possibles sur les 65 536 théoriquement disponibles puisque le volume a été fortement diminué.

C’est dans ce type de conditions et avec des écouteurs Shure SE535 que François Simond (un ingénieur bien connu dans le monde Android, notamment pour ses travaux dans le domaine du son, comme Voodoo Sound) m’a confié réussir à distinguer la distorsion des formes d’ondes. Le traitement et mixage de sources sonores puis une sortie en 24 bits permettrait alors de repousser cette limite grâce à un plus grand nombre de valeurs disponibles puisque la plage dynamique (exprimée en dB) est plus grande : 96 dB pour le 16 bits et 144 dB pour le 24 bits. On peut donc penser que le 24 bits apporte une meilleure qualité audio aux mélomanes que les 96 et 192 kHz. La cerise sur le gâteau, c’est que la source sonore (le morceau de musique) n’a pas besoin d’être en 24 bits pour profiter de cet apport.

Le 24 bits assure donc une plus grande marge dans tous les cas.

En effet, prenons l’exemple d’un smartphone. Si le fichier sonore est échantillonné en 16 bits mais que le DAC (la puce qui convertir le signal numérique en signal analogique pour l’envoyer vers la sortie audio) est capable de traiter la musique en 24 bits, la plage dynamique disponible sera plus élevée qu’avec un DAC 16 bits du fait des pertes lors du traitement. Si le fichier est échantillonné en 24 bits, c’est encore mieux puisqu’il y aura une marge de manœuvre plus élevée. Il faut également savoir qu’il y a des pertes de plage dynamique (mesurées avec le rapport signal – bruit et exprimé en dB) qui peuvent provenir du matériel utilisé. Le 24 bits assure donc une plus grande marge dans tous les cas.

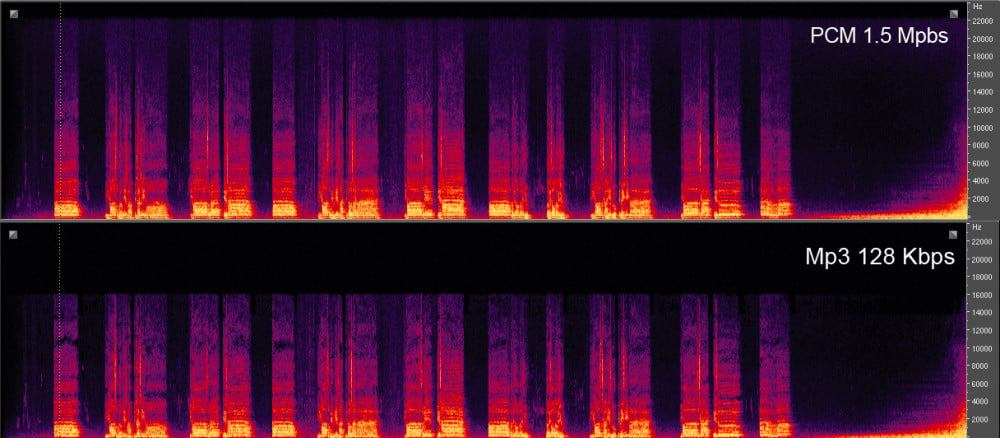

Gare à la compression

Enfin, le dernier élément à prendre en compte tient à la compression du fichier audio. Le MP3 réalise une compression dite destructive puisqu’elle supprime des éléments du spectre sonore qui sont, en théorie, peu audibles pour l’homme. Mais même avec une écoute aveugle, on distingue clairement une différence de qualité entre un MP3 encodé à 128 kbps (le nombre d’informations contenues sur une seconde de musique) et le même fichier encodé à 320 kbps. La différence entre un MP3 à 320 kbps et un fichier non compressé est un peu plus délicate à saisir, mais elle existe bien. On trouve alors le format de fichier FLAC, qui dispose d’un algorithme de compression non destructeur. Le fichier est plus petit qu’un WAV mais dispose des mêmes informations. Ce format de fichier est celui utilisé par Qobuz pour la musique HD sur les appareils mobiles.

L’audio HD sous Android

Depuis plusieurs mois, les constructeurs de smartphones commencent à mettre en avant la musique HD 24 bits / 192 kHz ainsi que le format de fichier FLAC. Mais est-ce un réel argument ? Il y a plusieurs manières de répondre à la question. Tout d’abord, cet argument est utile à une infime minorité de la population. Pour profiter de la différence de qualité d’un fichier source HD, il faut disposer d’un excellent casque ou d’un système hi-fi avec ampli et enceintes de très bonne qualité. Pas besoin, en revanche, d’un système compatible 24 bits, ils le sont tous puisque le signal numérique est transformé en signal analogique lors de sa sortie. Il faut également que toute la chaîne matérielle et logicielle suive sur le smartphone : de l’application d’écoute au DAC en passant par le pilote et le mixer. Android supporte nativement le 24 bits, et même la définition audio 32 bits. Mais ce n’est pas forcément le cas du reste des maillons de la chaîne.

Finalement, les smartphones compatibles 24 bits / 192 kHz comme le nouveau HTC A9 ou le Marshall London mais également 24 bits / 96 kHz sur certains smartphones Xperia de Sony ont peut-être d’autres arguments à faire valoir. C’est par exemple le cas de la double sortie casque du Marshall London ou ses haut-parleurs stéréo très puissants. Encore faut-il que l’ensemble de la chaîne soit compatible et que l’argument de l’audio HD ne soit pas simplement marketing, avec un traitement logiciel réalisé en 16 bits.

Dans tous les cas, l’audio HD est une bonne chose selon moi. Cette mode tire en effet l’industrie mobile vers le haut, puisque même si la différence entre un son HD à 24 bits / 192 KHz et un son « standard » à 16 bits / 44,1 KHz est inexistant pour certain et léger pour d’autre, il n’a pas vraiment d’effet négatif. Le seul que l’on pourrait citer est le prix facturé par les catalogues musical pour bénéficier d’une source audio en HD. Mais comme on l’a vu, même sans source HD, les 24 bits peuvent améliorer l’expérience audio sur smartphones. Toutefois, avant de vouloir à tout prix un smartphone supportant la musique HD, il vaut mieux investir dans un bon système d’écoute. Le bond en qualité sera largement supérieur à celui permis par la musique en HD.

Votre intérêt pour l’audio de qualité ?

Il est bien entendu possible de mesurer la capacité des smartphones à jouer nativement de la musique 24 bits sur un smartphone et une tablette, tout comme de nombreux autres indicateurs de qualité (comme le rapport signal bruit notamment). À nous, donc, de vous poser une question : seriez-vous intéressé à l’idée de savoir si les appareils que nous testons sont réellement compatibles 24 bits / 192 kHz, de connaître la puissance de leur sortie casque et la qualité de cette dernière, tout comme la latence audio (extrêmement importante pour les amateurs de MAO) ? Si c’est le cas, nous pourrions creuser l’idée de créer un protocole de test objectif pour la partie audio.

énorme biais : vous confondez la fréquence avec la précision (en général il y a toujours un fourieriste zêlé pour dire que c'est la meme chose) mais si des fréquences sonores s'entendent, et peuvent être considérées comme de la musique, la signature harmonique d'un instrument ne se résume pas aux fréquences que l'on peut en extraire avec des formules de fourier. allez essayer de reconnaître un crissement, un cisaillement avec du 16bits 44khz et ensuite faite pareil avec un 24bits 96khtz, et revenez dire que vos ne faites pas de différence, même à 60 ans...

Je me suis renseigné. J'ai visité un studio de mastering où l'on m'a expliqué que l'on prépare justement un master particulier pour les vinyl car ils ont des limitations physiques dans ce qui peut y être gravé, limitations qui n'existent pas sur les formats numériques... Sans compter le niveau de bruit plus mauvais, les éventuelles variations de vitesse de lecture, craquements dus à la poussière, etc... Bref, pas "lossless" pour un sou. A la limite, les formats magnétiques analogiques sont plus fidèles... Les enregistrements récents étant enregistrés et mixés en numérique, on peut difficilement faire plus fidèle en les distribuant directement à l'auditeur.

Bonsoir, je vais faire court...Sachez que certain CD ne dépassent pas les 20 Khz (alors que "normalement" ça monte jusqu'à 22Khz), soit le spectre identique à un fichier MP3 en 320kbps. Et arrêtez de croire tout ce qu'on vous dit. Beaucoup de fichiers soit disant "High Res" sur Qobuz ne le sont pas du tout !!

Le nombre de bits détermine uniquement le rapport signal bruit. Avec le dither, on peut même descendre en dessous de 16 bits. La fréquence échantillonnage doit uniquement être le double de la fréquence audible, donc 44 kHz est amplement suffisant. Voir la vidéo "Digital Show and Tell (with subtitles)".

Non mais le support a de sérieuses limitations, par exemple une bande passante plus limitée, moins de dynamique, une séparation G/D qui doit être limitée dans le grave, etc... qui nécessitent un mastering spécifique tenant compte de ces contraintes (qui n'existent pas pour le numérique). Et il y a les limitations physiques du support : sa précision de gravure, le fait que le support se détériore à chaque lecture, il peut être poussiéreux, l'inertie de la pointe, l'entrainement peut être irrégulier (un peu comme le jitter en numérique mais en pire)... Pas franchement "lossless" par rapport au master d'origine.

Le vinyl est le seul format qui enregistre ses pistes en analogique directement et en lossless car il n'y a pas de bits sur un vinyl --' le seul facteur limitant est la taille qui limite la durée de ce que l'on peux mettre dessus, la qualité de l'enregistrement ne dépend que de la qualité de la piste utilisé en mastering... en général 96kHz/192kHz @24bits, renseigne toi avant de dire n'imp --'' !!

Le vinyl est le seul format qui enregistre ses pistes en analogique directement et en lossless car il n'y a pas de bits sur un vinyl --' le seul facteur limitant est la taille qui limite la durée de ce que l'on peux mettre dessus, la qualité de l'enregistrement ne dépend que de la qualité de la piste utilisé en mastering... en général 96kHz/192kHz @24bits, renseigne toi avant de dire n'imp --'' !!

"un fichier 24bit sonne exactement comme le même fichier en 16bit donc pas la peine de s'embêter avec, surtout si on considère que le MP3 320kb/s sonne pratiquement comme un CD". Je n'ai jamais lu autant d'inepties en une seule phrase. Belle perf !

Les fréquences inaudibles sont coupé, la redondance entre les canaux simplifié. Jean Louis n'a surement jamais fait de test ABX. il est très peu problable qu'il entende la différence entre un MP3 320 encodé correctement et son Wav d'origine. Ce qu'il entend c'est sa psychologie et ses croyances qui lui font entendre, des dizaines de test ont été effectué, les formats de compression à perte ont leur "débit de transparence" reconnu.

"Tout d'abord, un vinyl est intrinsèquement techniquement inférieur à un CD. ". Bien sûr mais il faut noter au passage que le mixage (à partir des pistes master) étant le plus souvent différent pour un vinyl et un CD on ne peut pas comparer ces deux versions pour le même morceau. Aussi, la grande marge de dynamique en 24 bits permet de faire un peu n'importe quoi, depuis le 24 bits même les plus mauvais ingénieurs du son peuvent garder leur postes. On le voit sur bien d'enregistrements passés sur 24 bits.

"Si on divise le débit moyen de données par 3 (MP3a320/FLAC1000+), il y a forcément une perte, il faut réapprendre à écouter la musique." c'est clair mais va dire ça à des gugusses qui ont éduquer leurs oreilles au mp3

bah sur le micro de mon smartphone xperia entre un vulgaire mp3 en 320 et un fichier 24bits c'est le jour et la nuit. entre du 16b et du 24 b je veux bien croire qu'à la limite des pros ne font pas la différence mais entre du mp3 et du flac c'est flagrant et j'ai 50 ans

bah c'est evident que tu vas pas mettre une bibliotheque dessus. on parle d'audiophilie pas de kéké qui se balade dans la rue

"surtout si on considère que le MP3 320kb/s sonne pratiquement comme un CD." mais oui c'est ça.qu'est ce qu'il faut pas lire

Un grand grand bravo pour cet article.

Honnétement le coup du 16 vs 24 bit me parait très naif, sans test en double aveugle, je n'y crois pas.

Non, l'aac et le mp3 sont 2 codecs complètement différents.

Et l'aac c'est quoi ? Du mp3 et même pas en 320 en plus de ça. Le 24 août 2016 5:10 PM, "Disqus" a écrit :

Apple a toujours soutenu l'aac, pas le mp3.

Je n'ai pas dit qu'il y a une différence entre du FLAC et du Wawe , mais qu'il faut des fichiers FLAC de bonne qualité. Parce-que souvent sur les sites de téléchargement gratuit les fichiers en FLAC sont de mauvaise qualité. Par exemple un fichier FLAC créé à partir d'un MP3. Le 15 août 2016 8:17 PM, "Disqus" a écrit : "Il n'y a pas de "FLAC de plus mauvaise qualité" par rapport à un format WAV. C'est strictement la même qualité, de la même manière qu'une archive ZIP restitue exactement son contenu quand on la décompresse. Je confirme aussi que quand on fait un test en aveugle, la différence de qualité entre MP3 320kb/s et qualité CD est certes là mais, selon les morceaux et les conditions d'écoute, il faut vraiment la chercher voire elle est inaudible." [image: Disqus] Settings A new comment was posted on FrAndroid ------------------------------ *ziv* Il n'y a pas de "FLAC de plus mauvaise qualité" par rapport à un format WAV. C'est strictement la même qualité, de la même manière qu'une archive ZIP restitue exactement son contenu quand on la décompresse. Je confirme aussi que quand on fait un test en aveugle, la différence de qualité entre MP3 320kb/s et qualité CD est certes là mais, selon les morceaux et les conditions d'écoute, il faut vraiment la chercher voire elle est inaudible. 2:17 p.m., Monday Aug. 15 | Other comments by ziv * Reply to ziv * ziv’s comment is in reply to *christophe hofmann* : Ben justement j'ai fait le test avec mon Meizu Pro 5 et mon beyerdynamic Custom One Pro. Et je peux l'affirmer que tu ... Read more ------------------------------ You're receiving this message because you're signed up to receive notifications about replies to christophe_hofmann. You can unsubscribe from emails about replies to christophe_hofmann by replying to this email with "unsubscribe" or reduce the rate with which these emails are sent by adjusting your notification settings . [image: Disqus]

lol. faut se détendre les gens. c'est pas parce que on écoute du mp3 qu'on as pas le droit d'avoir un bon casque... même si on écoute du mp3, un bon casque ne peux que rendre la qualité du son meilleur et tout le monde n'est pas au courant qu'on peux télécharger ses sons en flac. moi même je sais cela que depuis très peux de temps. biensur je me suis empressé de retélécharger tout mes alnums en flac des que je l'ai sue. Pour ce qui est du 24 bit je suis d'accord avec toi. si la diference n'est pas audible je ne voie vraiment pas l'interêt d'écouter ses son en flac 24 bit dans la rue sur son smartphone. d'autant plus que si on cherche la qualité maximal a la maison vaudras mieux s'équiper d'un platine avec une bonne installation et s'acheter ses albums en vinyle.

Il n'y a pas de "FLAC de plus mauvaise qualité" par rapport à un format WAV. C'est strictement la même qualité, de la même manière qu'une archive ZIP restitue exactement son contenu quand on la décompresse. Je confirme aussi que quand on fait un test en aveugle, la différence de qualité entre MP3 320kb/s et qualité CD est certes là mais, selon les morceaux et les conditions d'écoute, il faut vraiment la chercher voire elle est inaudible.

Ben justement j'ai fait le test avec mon Meizu Pro 5 et mon beyerdynamic Custom One Pro. Et je peux l'affirmer que tu entends une réelle différence. Le son est beaucoup plus claire en 16 bit donc qualité CD qu'en MP3 320kbps .Et il est bien plus détaillé. Par contre je suis 100% d'accord pour dire qu'il n'y a aucune différence entre du 16 bit et du 24 bit . Ou alors elle est vraiment infime, mais moi j'en vois aucune . Peut être qu'avec un casque à 1000€ , on entend une différence, mais même avec cela je ne pense pas. Après il faut aussi avoir des fichiers 16 bit de bonne qualité pour faire ce test bien évidemment. Parce-que sur la plupart des dites de téléchargement gratuit, les fichiers FLAC sont de mauvaise qualité.D'ou ma préférence pour le Wawe sur ce genre de site , même si ça prend plus de place que du FLAC. Le 13 août 2016 9:20 PM, "Disqus" a écrit :

La meilleure démarche scientifiquement valide est le test ABX. C'est très facile à faire : prendre un morceau "de référence" et le réencoder dans une qualité inférieure (e.g. 24bit->16bit, lossless -> MP3) et utiliser le plugin ABX comparator de foobar2000.

J'entends ton argument, mais je ne pense pas qu'il suffise de s'abonner à du streaming HD pour entendre la différence, même avec du mp3 320kbps. Pour t'en assurer, il te faudrait faire un test à l'aveugle (quelqu'un enchaîne un même morceau, issu d'une source véritablement HD, et le même réencodé correctement en MP3 320kbps, à même niveau sonore, et le testeur ne voit rien mais se contente d'écouter). Sans cette démarche, le subjectif s'engouffre à vitesse grand V : chacun préférera la version à laquelle il s'est abonné, la version super audio CD qu'il a achetée, etc. Bien sûr, le MP3 supprime une partie du message sonore. Encore faut-il réellement entendre une différence vis-à-vis d'une version par exemple CD (16 bits 44,1khz donc), et ne pas subjectivement croire des arguments jamais démontrés en situation (objective) réelle. Une piqûre de rappel : http://nwavguy.blogspot.be/2011/05/subjective-vs-objective-debate.html

Oui après Qobuz en profite bien , ils vendent leurs abonnement Hi-Res la peau du cul . C'est pour cela que j'ai pris le 16 bit qui suffit largement. Même si 20€ c'est déjà une somme. Mais je préfère mettre 20€ par mois pour du 16 bit que 10€ pour du MP3 à la cons qu'ils osent appelé cela HD en plus de ça . Le 12 août 2016 8:30 PM, "Disqus" a écrit :

Effectivement Android authority , fond du bon boulot, j'aime bien leur tests. Les numériques, sont aussi assez bon dans ce domaine. Et tests plutôt bien l'audio quand le smartphone en vaut le coup . Le 12 août 2016 8:35 PM, "Disqus" a écrit :

C'est tout simplement parce que les appareils que tu site ne sont pas fait pour écouter du son en 16 ou 24 bit . Même si ils les prennent en charge , la prise jack et leur DAC ne le permettent pas, donc tu n'entendra pas vraiment de différence. Après il faut aussi avoir un casque correct pour entendre une réelle différence. Mais, si tu as l'occasion d'écouter du son avec un DAP ou un smartphone bien équipé genre Meizu Pro 5 , et évidemment un casque correct , va sur Qobuz, prend un essai gratuit de 15 jour pour pouvoir écouter des morceaux en 16 bit donc CD . Selectionne d'abord t'on morceaux en qualité MP3 , et directement dans la foulée, tu sélectionnes le même morceau en 16 bit . Et tu verras qu'il y a une réelle différence. Le morceau n'est carrément plus le même, pour certains morceaux.

C'est que vous écoutez pas bien vos morceaux.Parce que même en 320 kbps il manquera toujours des petits sons , qui peuvent complètement changer un morceau. Et pour sans rendre compte , il suffit d'aller sur Qobuz,( il y a 15 j d'essais gratuits) et d'écouter le même morceau d'abord en mp3 , et après en qualité CD .Et tu verras qu'il y a une réelle différence. Après il faut aussi un casque correct bien évidemment .

Acheter un bon casque et un DAP et non DAC externe , c'est ridicule. Après le son en 16 bit (qualité CD) suffit largement, parce-que pour entendre une différence entre du 16 et du 24 bit il faut déjà du putain de matos , et de sacrés oreilles. Parce-que une très grande majorité des personnes n'entendent pas la différence entre le 16 et le 24 bit . D'ailleurs j'en fais partie.Je remarques vraiment aucune différence entre les deux . Mais par contre entre du MP3 même en 320 et du 16 bit , il y a une énorme différence. Même si un bon DAC , fera en sorte d'améliorer l'écoute d'un MP3 il manquera toujours des sons sur n'importe quel morceau que tu écoutera.

Oui parce-que qu'ils n'écoute pas le même morceaux en qualité CD juste après l'avoir écouté en MP3 . Parce-que c'est comme le jour et la nuit . Il manque quand même beaucoup de petits son , qui peuvent carrément changer un morceau, selon le type de musique.

À l'époque où les lecteurs MP3 ont commencés à sortir, j'étais vendeur au rayon petit son à hyper media (actuellement boulanger). Et on pensaient tous que le MP3 était voué à l'échec, je conseillais plutôt aux gens d'acheter un baladeur mini disc qu'un MP3 . Mais on c'est bien gouré.Apple à réussi à faire en sorte que la plupart des gens écoutes du MP3 . Je trouve d'ailleurs que c'est dommage que les mini disc on disparus . C'était vraiment un support génial, un superbe son , et beaucoup moins fragile qu'un CD . J'avais d'ailleurs un lecteur mini disc Sony , qui était vraiment top. Certe il coûtait un peu chère pour l'époque 2800 francs , mais il était vraiment top . D'ailleurs quelques années plus tard il coûtait 1000 francs de plus.

Certains journalistes font bien leur boulot et expliquent en quoi un DAC 32 bits (ou même 24 bits) n'a aucune utilité pratique : http://www.androidauthority.com/why-you-dont-want-that-32-bit-dac-667621/

Le marketing de l'audio Hi-Res a l'air de se tasser un peu... Quoique, LG annonce un "Quad DAC 32-bit" pour son prochain haut de gamme, le LG V20. Mouais, on s'en fiche... On attend plutôt les performances en termes de puissance de sortie, linéarité du spectre, distorsion, etc...

C'est bien pour cela que j'ai pris l'abonnement 16 bit chez Qobuz et non le 24 bit , alors que pourtant mon Pro 5 permettrait l'écoute du 24 bit . Mais comme Sony à eut la bonne idée de sortir des appareils Hi-Res donc 24 bit , ben les sites genre Qobuz en profitent pour vendre des abonnements hors de prix.

Le Pro 5 de Meizu y arrive . Après ça doit être l'un des seuls smartphone du marché à pouvoir le faire, mais il le fait , et même très bien grâce à son ampli OPA 1612.

Avec mon Pro 5 je passe par la prise Jack , vu qu'il est équipé d'un ampli OPA 1612 qui fait très bien le travail. Et bien entendu un bonne prise Jack qui n'est pas limité à une faible puissance.

Tout dépend du smartphone. Avec un Pro 5 de Meizu , je te garantie que ce n'est vraiment pas du gâchis.

Une paire d'écouteurs à 300€ tiendra bien plus que 1 ans ou 2.

Les numériques , fonds des tests audio assez poussé lorsque le smartphone en vaut la peine.

Certe il faut écouter la musique assez fort, Quand il y a du bruit au tour, mais avec un volume élevé j'entends rien autour de moi. Le 11 juil. 2016 3:37 PM, "Disqus" a écrit :

Pour avoir souvent utilisé des Bose QuietConfort (ceux fourni en avion), c'est mieux mais c'est pas top non plus, du moins pas vraiment pareil que de réellement se trouver au calme. Bref c'est certainement très bien pour un très petit nombre, pour 95% de ceux qui se vantent de leur DAC intégré, c'est certainement inutile.

C'est pour cela qu'il y a des casques avec réduction du bruit. Et chez Sennheiser ou Beyerdynamic, tu as déjà du bon matos à 200 ou 300€ après c'est sur qu'a partir de 500€ tu as des putains de bon casque du genre Oppo PM-3 EU qui est juste une tuerie. Le 11 juil. 2016 08:48, "Disqus" a écrit :

Oui des casques, qui pour 200/300€ sont pour la plupart des casques d'image et non pas des casques des très bonne qualité. Enfin bref, je trouve ça un peu trop de vouloir chercher une tel précision quand au final on aura des bruits de voiture, les conversations des autres passager, ... ce qui sera bien pire que le gain apporté par le passage du mp3 au 16 bit.

Ben si, carrément. Tous les smartphones n'ont pas les mêmes DAC et autres composant audio. Mon Pro 5 est équipé de 4 transistors NPX, et je peux te dire que tu entends un putain de son ,même sur un système hi-fi Vu qu'il est équipé pour.

Tout dépend du tél. Mon Pro 5 à un ampli Hi Fi et dégage un putain de son sur un système hi fi. Pourtant je le branche en Jack. Seulement il est super bien équipé. Il a le même équipement qu'un bon DAP moyen de gamme.

Oui enfin un Pro 5 . Parce que les mx5 ,mx 4 ,m3 note ou autre n'ont pas de putains de dac intégré. Seule le mx 4 pro et surtout le Pro 5 ont des putains de puces audio. Le Pro 6 régresse d'ailleurs face au Pro 5 sur ce domaine.

Ben figure toi, que dans la rue, Je croise pleins de gens avec des casques à 200 voir 300€ sur la tête, malgré qu'ils écoutes du putain de mp3 à la cons genre deezer ou spotify. Donc c'est complètement inutile d'avoir un putain de casque pour cette utilisation, pourtant il y a énormément de gens qui le font. Par contre avec un Meizu Pro 5 , ou un Axon 7 par exemple ça vos le coup d'avoir un bon casque et des fichiers wawe ou flac 16 bits, parce qu'ils sont équipés d'une très bonne puce audio. Alors OK ils sont capable de lire du flac 24 bit. Mais je trouve cela inutile parce que on entend une différence entre du mp3 et du 16 bit. Mais on en entendra aucune entre du 16 et du 24 . À moins d'avoir un putain de casque à 2000€ .

Seriez-vous intéressé à l’idée de savoir si les appareils que nous testons sont réellement compatibles 24 bits / 192 kHz ? Oui, je le veux.

Tout d'abord, un vinyl est intrinsèquement techniquement inférieur à un CD. Le numériser en 96/24 ne le rendra pas meilleur. Ensuite, le Bluetooth effectue une compression (type MP3) qui dégrade le son. Cependant, dans l'environnement bruyant d'une voiture, c'est probablement indiscernable. Par contre, sur une enceinte, l'entrée AUX peut donner un meilleur rendu. Enfin, dans des conditions d'écoute normales et sur des morceaux "finis", un fichier 24bit sonne exactement comme le même fichier en 16bit donc pas la peine de s'embêter avec, surtout si on considère que le MP3 320kb/s sonne pratiquement comme un CD.

Bonjour J'ai plusieurs questions à poser aux audiophiles. D'abord, un vinyl encodé en flac en 24 bit 96KHz sera t'il meilleur qu'un CD ? Deuxièmement, j'ai un galaxy note 3, j’utilise souvent la fonction Bluetooth dans ma voiture. Vais je avoir une meilleure qualité sonore si je branche mon smartphone sur l'entrée auxiliaire au niveau de l'écoute des fichiers 24 bits (par rapport au Bluetooth)? J'ai demandé pour Noel la Bose SOundlink 3 pour écouter mes fichiers audio. Elle fonctionne soit en Bluetooth, soit en entrée auxiliaire, même question, sur cet appareil, y aura t-il une différence de son entre son fonctionnement sur bluetooth ou par entrée auxiliaire à partir du galaxy note 3? C'est pour savoir si dans le cadre de l'écoute de fichiers 24 bits, ca vaille le coup de brancher en AUX. SI c'est quelqu'un arrive à répondre à mes interrogations, merci. Je ne trouve pas de réponse sur le net. Je sais que le bluetooh compresse le fichier audio au dessus par exemple d'un mp3 320 kbps. J'ai un casque audio senheiser HD 650 sur mon pc, l'écoute des mp3 en 128 est une véritable horreur, il y a des bruits métalliques en fond. LE 320 passe par contre très bien. A Près ça devient difficile de voir la différence avec le 24 bits sauf un nouvel album remasterisé... Merci pour vous réponses.

hello. Super liste ça. Je cherche à remplacer mon Honor 6 et je suis vraiment à fond sur le son (Deezer HD, un bon casque Audio technica) et du coup, je cherche à identifier un bon smartphone audiophile. C'est dingue parce que y a pas grand chose sur le net. QoBuz a une page sur des tests, mais c est light (en référence de tel et en qualité des tests). du coup, je ne sais vraiment pas quoi faire... Quitte à me faire bacher, j'entends même que la marque à la pomme gère très bien le son... Côté Android, à part les chinois que tu as listé... Sinon autre solution : j'ai acheté un DAC USB HifiMe et ca assure grave. Faut le brancher au port USB du tel et c 'es tle DAC qui décode directement. Le seul souci, c 'est qu'il faut un tel qui supporte l'USB OTG audio. Le moto G 2014 de ma femme le fait très bien. L'Honnor 6 ne le fait pas..

Pour faire des comparaisons à mastering égal, il est facile de prendre un morceau de la meilleure qualité (24/192) et de le "downmixer" en 16/44,1 ou MP3. Par comparaison, on s'apercevra ainsi que la différence est subtile, au mieux...

Pas nécessairement, non. Les remasters ont plutôt tendance à "moderniser" les mixages donc à diminuer la dynamique. La seule différence entre un enregistrement 24bit et 16bit, c'est le plancher de bruit qui est déjà inaudible en 16bits. J'encourage tout le monde à se procurer un enregistrement 24bits et à le "downmixer" en 16bits afin de le comparer. Je parie qu'aucune différence ne sera audible et certainement pas au niveau de la dynamique.

Oui c'est aussi ce que je me disait, la qualité audio en branchement hifi, si elle est faite via un DAC, ne sera pas différente d'un téléphone à l'autre.

C'est la base du marché de la musique HD : proposer des remaster d'albums avec la dynamique restaurée, et mettre ça sur le compte du HD... sauf que recompressé en 16 bits, personne n'entendra la différence.

J'ai quand même un groooos doute sur la faculté d'un telephone a driver un HD800. Déjà sur mon AKG K712, le manque de jus se fait facilement sentir entre un fiio et un tel...

Sortie casque = passage par l'ampli du tel - et le DAC, qui est de la daube et modifie le signal. La sortie vers de un ampli hifi se fera plutôt via USB ou sortie dédiée.

De toute façon, de bon casque sur un tel c'est un peu du gachis. La sortie n'est pas forcement propre, ou n'as pas le jus pour alimenter correctement le casque, mais surtout, écoute de musique en environnement nomade, c'est pas spécialement les conditions optimales...

Je viens de faire la listes des Smartphones audiophiles du moment avec la référence du DAC utilisé : - Meizu MX 4 Pro (SABRE ES9018K2M DAC+OPA1612 Amplifier) - Vivo X5 Max (SABRE ES9601 DAC+OPA1612 Amplifier) - ZTE Nubia Z9 (DSP CODEC AK4961) - OPPO N3 (SABRE ES9018K2M DAC) - Xiaomi Mi Note Pro ( SABRE ES9018K2M DAC + OPA1612 Amplifier+ADI ADA 4896 op-amp) Liste non exhaustive, je vous invite à l'alimenter.

Merci, de plus je vois que tu possède un Astell and Kern, le AK100 n'est pas le haut de gamme de chez eux, mais tu as déjà un vrai lecteur audiophile et tu sais de quoi tu parles ! J'avais le MX4 Pro, et bien de mon côté j'ai trouvé le son qu'il dégageait meilleur que mon ancien Fiio X5 ainsi que mon iBasso DX50. Cependant mon iBasso DX90 garde une légère avance !

Toi petite poufiasse, je ne sais pas de quoi tu parles, mais t'as de la chance de ne pas être à côté de moi, je t'aurais bien casser ta bouche et c'est toi qui serais obligé de manger de la bouillie...

Et non je ne me la pete pas!!! Je crois un peu de monde dans le métro avec de bons intras...et je suis sur qu'il y a beaucoup de personnes ici qui ont trainé sur generationmp3 ou tellementnomade. Et non je ne me la pete pas!!!

ben moi je suis d'accord avec lui...pourquoi acheter un lecteur dédié si ton smartphone fait 99% aussi bien le boulot! Et j'ai un AK100ii donc milieu haut de gamme pour l'écoute ce qui ne m'a pas dégouté de l'écoute sur mon smartphone :)

Moi le premier morceau choisi (merci Jay Z truc) c'était du mp3 128 lol:)

Je vois tout le monde dire "Oui". Franchement, combien ont un casque capable de reproduire correctement les sons de ce types? et exit les casques marshall a 200€ qui ne sont pas à la hauteur comme beaucoup d'autres pourtant réputés ! <i>-------<a href="https://play.google.com/store/apps/details?id=com.frandroid.app">Envoyé depuis l'application FrAndroid pour smartphone</a></i>

Étant un audiophile et technophile à la fois, je trouve que l'idée d'évaluer les performances audio en tout genre des smartphones et tablettes que vous testez serait très appréciable, et ça serait pour moi un critère principal dans l'achat d'un smartphone par exemple.<i>-------<a href="https://play.google.com/store/apps/details?id=com.frandroid.app">Envoyé depuis l'application FrAndroid pour smartphone</a></i>

Encore faut-il que les constructeurs utilisent des codecs permettant le réglage du gain analogique. C'était le cas il y a quelques années, notamment lorsque Supercurio développé Voodoo Sound. Mais ce n'est plus le cas désormais.

Ca m'arrive de mettre de la musique sur mon smartphone en le reliant en bluetooth 4 sur le home cinema. Si le son pouvait être plus clair ce serait sympa ;-)

très intéressé aussi ;-)

encore un audiophile inculte, noyé dans une bouillie de pseudo connaissances... Le deuxième paragraphe est particulièrement gratiné...

lml

J'ai fait 2/6. Mais au moins je suis tombé sur le mp3 320 quand je me trompais :)

Je l'ai refais en prenant moins de temps (en gros je n'ai écouté qu'une fois chaque version). Le résultat est moins glorieux, lol !

"Seriez-vous intéressé à l’idée de savoir si les appareils que nous testons sont réellement compatibles 24 bits / 192 kHz ?" Oui, je le veux.

Merci pour cet article. Oui, cela m’intéresserai d'avoir ce genre d'info car je suis très déçu de la partie audio de mon appareil (LG G3) et j'aurai apprécié avoir plus d'info à l'époque.

Bravo...Pas mal du tout en tout cas, mais il faudrait le refaire pour vérifier que ce n'est pas que de la chance...je crois que l'ordre des cases change aussi :) Quitte ou double :!)

Oui bien sur...testé avec Note 3 et Note 4 fonctionne en usb OTG et en 24/192...

Tu mets des Sennheiser et des beats ensemble... Je trouve que le son des sennheiser (hors milieu de gamme)est plutôt très bon...après si tu as une meilleure marque à nous conseiller je suis toute ouïe :)

Ça ne me dit rien, désolé :/ Je me souviens aussi en avoir discuté avec un prof de Physique en fac il y a quelques années aussi (quasiment 10 ans), c'est d'ailleurs lui qui m'avait averti à ce sujet (il était acousticien à la base). Enfin je n'ai retenu que le plus important, soit les dommages qui peuvent être directement (ou indirectement) liés, il vaut mieux prévenir que guérir !

Content d'apprendre quelque chose ! Mais ce que je disais, c'est juste que ce que j'avais pu entendre dans un excellent reportage à ce sujet, et ils (les acousticiens présents) avaient juste réalisé cet état de fait (différence mp3/FLAC, augmentation de volume, etc) et c'est ce que je voulais retranscrire uniquement. Mais c'est toujours bien de préciser ^^

Si vous ajoutez des critères de tests (moi ca me plairait bien), il faudrait en vrac : - puissance de la sortie jack - détails du DAC + autonome ou dans le CPU - distorsion

pour avoir tester sur de nombreux tel... il faut aussi que le driver audio USB OTG soit installé dans la ROM du tel. sinon, le DAC USB ne fonctionne pas. Testé avec HTC ONE M7 (OK), Moto G (OK), Honor 6 (KO), nexus 5 (OK)

oui, pourquoi avoir délaisser tant de temps la sortie audio des smartphones. bien sûr qu'il faut tester non seulement la sortie casque mais aussi la facilité d appairage ainsi que la distance du Bluetooth.<i>-------<a href="https://play.google.com/store/apps/details?id=com.frandroid.app">Envoyé depuis l'application FrAndroid pour smartphone</a></i>

Étant donné que j'écoute la musique plus de 2h par jours je voûte Oui direct ! <i>-------<a href="https://play.google.com/store/apps/details?id=com.frandroid.app">Envoyé depuis l'application FrAndroid pour smartphone</a></i>

Un encodage 16 bits est largement suffisant. Il faut juste que les fabricants de téléphone arrêtent de n'utiliser que les réglages de gain digital pour ajuster le volume d'écoute, et qu'ils utilisent le gain analogique des amplis de la sortie casque. En utilisant le gain digital, on coupe l'amplitude du signal (on utilise une partie des 65536 valeurs possibles avec le 16 bits), alors que l'ampli de sortie reste au même gain, donc avec un même niveau de bruit = dynamique de merde et SNR qui dégringole. Si on utilise le gain analogique de l'ampli, on conserve le gain digital à 1, on utilise l'amplitude totale du signal et la dynamique complète du convertisseur audio numérique/analogique, puis on atténue le signal et le bruit en réduisant le gain analogique de l'ampli = la dynamique reste maximale et le SNR reste le même.

Bonjour, En tant qu'audiophile, je vote "POUR ou OUI" comme vous voulez, pour des tests plus poussés et plus détaillés sur la partie audio embarquée de nos futurs smartphones. Effectivement, je trouve qu'il est très intéressant de savoir si son smartphone est compatible avec les flux audio HD 24bits/96kHz et 24bits/192kHz (appelés aussi Flac HD, SACD ou Studiomaster), et si pour les décoder celui-ci possède une puce dédiée (DAC) tout comme le Meizu MX4 Pro qui excelle dans ce domaine, c'est d'ailleurs le seul domaine où il excelle car pour le reste, vous pouvez le jeter à la poubelle) avec sa puce (DAC) Sabre ES9018K2M. De plus, les acheteurs (audiophiles potentiels) n'ont pas forcément les moyens de dépenser entre 400 et 600 euros pour un smartphone puis entre 200 et 5000 euros pour un DAP audiophile (baladeurs audiophiles) dédié que sont les iBasso, Fiio, Cowon, Astell and Kern et autres Hifiman (les meilleurs selon moi). Je vous félicite pour ce petit article très synthétique mais compréhensible pour le commun des mortels. Je vous invite aussi à rapprocher du site tellementnomade.org (site spécialisé dans l'audio) pour éventuellement travailler en collaboration étroite afin d'ajouter une partie "Smartphones Audiophiles" dans leur futur guide d'achat pour Noël 2015. Merci et continuez comme ça !

De quel type de branchement hi-fi parles-tu? Le branchement en hi-fi se fait par la sortie casque non? Et concernant l'usage d'un DAC externe en micro-USB cela doit être équivalent sur tous les téléphones ou je dit une bêtise?

Je voulais dire qu'avec les in-ear que je cite la différence d'un smartphone à l'autre ne se fera pas vraiment entendre (d'accord avec faux iPhone acheté 50€ à Shenzhen, ça sera flagrant). Sinon combien de personne utilisent des écouteurs à 300€ et +? Une grande majorité utilisent des écouteurs intra-auriculaire, qui on en générale une durée de vie assez courte, j'imagine donc qu'ils ne mettent pas 300€ chaque année dans une paire d'écouteur...

Merci pour ton retour, je vais donc zapper les sony des lecteurs audiophiles :) Je préférais quand même le son du Note 3 au Note 4 mais bon...

Test : 5/6 2 fois de suite mais j'ai du monter le volume et revenir sur certains morceaux car c'était pas franchement évident...surtout Tom's Diner mais par contre je me fais avoir à chaque fois sur Jay Z(pardon pour lui)...bref pas mon type de musique du tout pour moi que le morceau 128kps ou non compressé,mes oreilles n'aiment pas!

Lol..oui en fait je me suis alarmé pour rien...mais il est resté longtemps en modération avant d'apparaître le lendemain seulement.

Peut être qu'avec un Note 4 le son est bien meilleur, je n'ai jamais testé. Mais ayant eu un S3, S4 et Note 3, je t'assure que le Z3 et le Z2 leurs mettent une sacrée claque. Peut-être est-ce la manière dont les gammes Sony restitue le son qui me plait plus que ce que font les Samsungs.

je vais faire le test indiqué plus bas quand je serais au calme et je ferais un retour http://www.npr.org/sections/therecord/2015/06/02/411473508/how-well-can-you-hear-audio-quality avec le matériel suivant : Intras Sennheiser IE800 +AK100II Après je remarque surtout des différences entre le mp3,wav et les fichiers HD 24/192 ou DSD peut être que le mastering est différent aussi :)

Pour info, j'ai pas écouté, j'ai cliqué au hasard, et j'ai eu 3/6 :) Ensuite j'ai réécouté en connaissant la réponse, bin même avec ça, c'est pas évident du tout de faire la différence...

Ben alors achète un Meizu, ils ont les meilleurs DAC audio intégrés à leurs smartphones!! Tu sera époustouflé !!

Article intéressant et oui j'aimerais cette partie test sur les smartphone en particulier sur le nouveau Meizu PRO 5 :) <i>-------<a href="https://play.google.com/store/apps/details?id=com.frandroid.app">Envoyé depuis l'application FrAndroid pour smartphone</a></i>

Bah moi je m'en bas le steak de l'audio HD, parce que j'ai les oreilles toutes pourries avec des acouphènes car j'ai écouté du métal a plus de 100 dB pendant plus de 10 ans sur mon Walkman a cassette. C'est la vie !

Le bluetooth aptx permet de se rapprocher de la qualité du CD audio, guère plus. Ça reste bien insuffisant pour de l'audio HD. Cela dit, je me contenterai déjà bien de ça en usage nomade avec un casque sans fils.

Le "uncompressed wav" est la plus haute qualité possible, après on peut avoir plusieurs qualités de wav selon, justement, la fréquence d'échantillonnage mais si on ne fait pas la différence entre un mp3 320 et un wav 44.1khz on ne la fera pas non plus entre wav 44.1khz et wav 88.2khz. Elle est encore plus minime et encore une fois, un matériel qui soit si précis qu'on entendrait quand bien même cette différence, est forcément très très haut de gamme et étudié pour une écoute technique. Du très haut de gamme hi-fi, pour une écoute musicale donc, est moins précis que du matos de gamme moyenne de studio. Et c'est fait pour, parce que le mélomane écoute la musique et pas la technique. Je suis en train de regarder une vidéo d'un enregistrement d'un groupe de Jazz/Funk, à la Nouvelle Orléans , dans le studio qui a enregistré, entre autre, Evanescence, donc c'est pas des rigolos... Hé bien l'ingé-son enregistre en 24bits 44.1khz. Et même avec la qualité Youtube ça sonne déjà très très bien, et le morceau n'est même pas encore mixé. Je mets la vidéo pour ceux que ça intéresse. https://www.youtube.com/watch?v=FKvEMSnNfwQ

Ha tient il faudra que je fasse le test, j'ai toujours mon iRiver H320 ^^

Je me suis vautré aussi sur le passage avec la voix seule. Impossible d'entendre une différence. Par contre plus il y a d'instruments, plus on entend la différence. Je veux le même test mais avec de l'audio HD en plus.

J'ai fait 5/6 avec un casque Gamer (pas vraiment le top pour la musique). Peut être de la chance aussi :)

Le fait que Mederick Colignon soit jazzman n'est pas garant d'une meilleure perception de la qualité sonore. En effet en jouer en live ou en répétition démoli les oreilles. Moi je ce que je peux dire c'est qu'en enregistrant en 96khz 24bis non compressé sur un Zoom H6 la différence est flagrante avec du 16bis 44khz. Mais pas au point de ne pouvoir s'en passer.

Je l'ai déjà réclamé plusieurs fois, donc je vais pas dire le contraire maintenant:Oui, je veux une partie son sur les test des smartphones..

Quobuz en fait qques uns, mais 2 ou 3 par an pour ce qui est des smartphones. Euh.. Une paire de on ear Audio Tecnica à près de 300€, j'ai pas testé mais je suis sûr que tu sens la différence.. ;)

Les deux premiers graphiques sont trompeurs : en vrai, le son produit par une carte son n'est jamais crénelé. Ce n'est qu'une représentation informatique artificielle de l’échantillonnage qu'on ne retrouve pas du tout sur le signal qui sort du DAC et tel qu'on peut le mesurer à l'oscillo. De même pour le graphique représentant la perte dans les aigus pour le MP3 : plus personne n'utilise le MP3 128kb/s. A 320kb/s (qualité "HQ" de Deezer, Spotify, etc...), l'encodeur bien connu LAME n'effectue aucun filtrage "passe bas".

Attention à ne pas confondre compression de dynamique (responsable de la sensation de son "fort" sur les pubs et les enregistrements pop récents) et la compression psychoacoustique (MP3, AAC, AC3...) qui respecte la dynamique du son d'origine mais supprime les sons trop faibles pour être entendus.

La gamme Xperia haut de gamme est mauvaise élève dans la lecture audio HD même SONY en vante les possibilités. Mon Note 4 (pourtant en Snapdragon donc DAC identique) c'est le jour et la nuit à côté d'un Z3, on sent que l'un peut rivaliser avec des baladeurs dédiés de gamme correcte : Sur le Note 4, que ça soit la puissance de sortie, la diaphonie, la dynamique et l'aération...tout y est bien meilleur, le Z3 ne rentre même pas dans la catégorie des baladeurs à 150€ pourtant pas très difficiles à concurrencer puisque comme je le prouve, un DAC Qualcomm quand on prend la peine de le maitriser offre de très bons résultats (et HTC l'a bien compris !)

Avec les cartes microSD 64/128Go la place pour la musique n'est pas vraiment un soucis.

On ne connaît pas sa jeunesse :p

oui intéressé par des articles sur la qualité audio des smartphones et des articles audio accessoires <i>-------<a href="https://play.google.com/store/apps/details?id=com.frandroid.app">Envoyé depuis l'application FrAndroid pour smartphone</a></i>

On ne dit plus audiophile mais idiophile depuis que de nombreux tests ont démontré l'inutilité de la "HD" audio. L'humain n'entend rien de plus que son spectre audio

haha ouai mais là on parlais d'un jazzman ^^

Vas dire ça aux groupes de rock / métal qui jouent sur scène (et vont en concerts) sans boules quies ;)

Faire une partie audio dans les tests de smartphones serait vraiment un plus, aucun site ne fais de test sérieux sur cette partie pour le moment (seul les numériques donnent quelques info dans leurs tests récents mais qui restent assez incomplètes). Ça vous permettrait de vous démarquer en proposant quelque chose en plus dans vos tests ;)

Stereotypes ... Stereotype everywhere !

Ayant un Xperia Z2, des intra Sony SBH80 et un Plantronics BlackBeatPro, oui je serai plus qu'intéressé par ces retours sur l'audio! Merci pour cette news. Je n'ai jamais été me renseigner sur ces histoires de Hertz et bits audio, pourtant j'arrive à me rendre compte de l'importance d'avoir du matériel de qualité ainsi qu'un bon encodage de sa musique. Je me suis toujours demandé si la gamme Sony avait un codec particulier ou autre qui rendait le son aussi bien l'article à l'air de confirmer. Pourrions nous en savoir plus sur la norme bluetooth aptx dans un prochain test? Si j'ai bien compris, grossièrement elle retransmet l'audio de manière HD?

Ha ok, franchement ca m'étonne, pour moi surtout pour un musicien les oreilles ca se proteges

Je côtoie de nombreuses personnes qui travaillent dans le monde de la musique et les problématiques d'audition sont courantes à cause des expositions répétées à des très haut volume sonore (concerts, festivals, balances, casque, etc.). Surtout avant où les limites étaient moins respectées.

En effet, c'est un point intéressant. Après, ce qui est le plus gourmand, c'est davantage le 96 / 192 KHz que le 24 bits en lui même (http://www.comparatif-audio.net/les-qualites-studio/).

pas adapté aux smartphones peut-être, mais adapté aux produits audiophiles utilisés (encore que c'est des casques grand public, avec un bon rapport qualité-prix, pas des casques 'audiophiles' du haut du pannier)

si c'est entre non compressé et mp3 à 320kbps, tu peux te rassurer, presque personne n'entend de différence... (si c'est du mp3 à moins de 192kbps en débit constant, c'est autre chose par contre)

Sisi, c'est imaginable, l'intégrale des beatles en 24bits/44.1 ça prend à peine 5Go pour 14 album dont 2 doubles. 1 vinyle en 24bits/96kHz c'est 800Mo, y'a de quoi en coller des albums sur un smartphone. :D

Je ne suis pas d'accord quand vous dites que le 24 bits n'a pas d'effet négatif. Du point de vue acoustique vous avez raison, mais ces fichiers prennent énormément de place. Caser du 16 bits sur son smartphone n'est déjà pas toujours évident, alors du 24 bits c'est inimaginable. Même avec une microSD, le ratio place/qualité du 16 bits est bien plus avantageux. [D'ailleurs à aucun moment vous ne mentionnez la compatibilité du 24 bits avec les smartphones en terme de stockage. C'est un point essentiel je trouve, mais je cherche la petite bête.] Donc pour un smartphone, je trouve que le flac 16 bits est le plus avantageux tous formats confondus. L'article est très intéressant et c'est une super idée de parler de sujets plus généraux comme celui-là ! Et le London est vraiment super beau je trouve !

Pas vraiment pour moi, je me contente de Sennheiser CX160 pour écouter mes podcasts... Il n'y as pas de site spécialisé pour audiophile qui proposent ces tests? Parce que de ce que je vois dans la rue la plupart des passants utilisent des in-ear Apple, Philips, Sennheiser ou Beats Audio. Pas vraiment le genre de casque avec lesquels une différence se fera entendre...

Ton commentaire à du recevoir trop de vote négatif et as donc était supprimé par disqus...

Pour ce qui est de la partie audio je pense que oui un test détaillé serait très intéressant pour pas mal de monde, surtout que d'autres sites le font

"De plus, on peut penser que leurs oreilles ont été exposé à des niveaux sonores élevés du fait de leur métier, ce qui contribue à réduire leurs capacités auditives." N'importe quoi XD putain les mec relisez vous c'est d'une connerie affligeante de dire ca, vous croyez que les mec bossent au marteau-piqueur

Oui c'est sur que l'audio HD dans les transports en commun c'est pas top...là je me sers d'un casque réducteur de bruit sinon au boulot j'ai de bons intras et un lecteur mp3 dédié sinon mon Galaxy Note 4 dont le son est pas mal non plus (surtout depuis le passage sous lollipop) je trouve

Si le Dac du Samsung est vraiment bien alors j'achète de suite...si l'écran n'est pas edge bien sur ! Et si retour de la carte microsd(ma musique HD prend de la place plus d'1Go par album)

+1 Ca m’intéresserait aussi d'avoir un comparatif de la qualité audio des sorties jack de différents téléphones.

Super article. Merci<i>-------<a href="https://play.google.com/store/apps/details?id=com.frandroid.app">Envoyé depuis l'application FrAndroid pour smartphone</a></i>

J'aimerais bien voir voir cette indication effectivement, il s'agit d'un composant essentiel dans un smartphone et je trouve qu'il s'agit d'un critère important dans le choix d'un téléphone. Concernant l'hégémonie du format MP3, les seuls points forts du format MP3 c'est sa légèreté (débits de téléchargement et espace de stockage limités) ainsi que sa compatibilité avec un grand nombre d'appareils, mais la qualité est réellement médiocre. Si on divise le débit moyen de données par 3 (MP3a320/FLAC1000+), il y a forcément une perte, il faut réapprendre à écouter la musique.

La longueur d'onde s'applique pour toutes les ondes comme son nom l'indique. C'est la longueur entre deux impulsions (les bosses). Quand tu prends l'inverse que tu multiplies par la vitesse de ton onde (la célérité de la lumière pour les rayonnements électromagnétiques) tu obtiens la fréquence qui est en Hz qui est équivalent aux s-1 en système international. Mais peut-être faisais tu référence au moment de l'article où il est écrit une longueur d'onde en Hz.

"Seriez-vous intéressé à l’idée de savoir si les appareils que nous testons sont réellement compatibles 24 bits / 192 kHz, de connaître la puissance de leur sortie casque et la qualité de cette dernière, tout comme la latence audio ?" Oui

Et puis ce n'est pas parce qu'on ne distingue pas la différence que ça ne peut pas être meilleur pour nous à l'heure où on commence à penser que les troncatures du MP3 engendrent des acouphènes.

Je suis désolé mais j'y crois pas... Attention je parle là d'un mp3 320 donc de très bonne qualité et une compression relativement faible, c'est sur qu'avec un mp3 à 64kbs c'est dégueulasse ! Et puis, ça dépend quel baladeur et quels intras aussi, mais un ipod ou un smartphone lambda et les écouteurs livrés avec ne sont de toute façon pas capables de reproduire les fréquences les plus hautes et les plus basses et devine quoi, c'est la que la compression mp3 agit le plus. Écoute un chant de femme acapella en wav et mp3 128 la différence sera faible, fais la même chose avec du hip hop et la différence sera flagrante.

Je comprends parfaitement ce que tu veux dire je l'entends moi aussi cette résonance mais pas sur du 320 ! Même sur du 128, selon les morceaux, avec un spectre qui descend pas trop bas et monte pas trop haut ça reste largement acceptable. Pour un morceau riche avec un spectre bien rempli 128 c'est vraiment désagréable mais 320 c'est largement bon.

Tu fais facilement la diff entre un mp3 320 et du wav même avec du matériel bas de gamme, y'a une forme de son parasite un peu comme une sorte de résonance métallique (je ne sais pas comment le dire autrement) sur les mp3. Après, pour le 44.1 et 24/96 ça s'entend surtout avec tout ce qui est instrument acoustique, le rendu est beaucoup plus fin et t'as pas l'impression que les instruments ont été étouffé.

Sympa le lien, j'ai fait 3/6 avec un z3 compact et des intras JBL Bluetooth. Autant dire que ça dépend non seulement du matos mais aussi du son qu'on écoute, sur le morceau de voix je n'entend aucune différence, toujours avec mon matos nomade, je reessayerais avec un meilleur matériel.

c pour moi un critère primordial lorsque j'achète un nouveau téléphone je regarde directement si la parti audio à été travaillé (amélioration audio, chipset audio dédié etc...) comme le fait ZTE et meizu sur leur flagship<i>-------<a href="https://play.google.com/store/apps/details?id=com.frandroid.app">Envoyé depuis l'application FrAndroid pour smartphone</a></i>

D'où le plutôt, ce n'est pas parfait (loin de là). Y'a des erreurs d'après certains commentaires; je n'en doute pas. Mais bon je trouve que ça change de "Le galaxy S7 sera potentiellement peut-être Force Touch" sur un article qui fait 3 lignes sans aucun contenu. Enfin bref, désolé pour mes propos d'hier, je m'étais levé du pied gauche ;)

Vous différenciez les sons wav, mp3 128k, mp3 320k ? faites le test ! http://www.npr.org/sections/therecord/2015/06/02/411473508/how-well-can-you-hear-audio-quality On peut constater une légère différence sur une bonne chaîne.

Mais putain mais c'est exactement ça !!! Excellent :)

Si vous voulez faire quelques essais avec votre installation actuelle (que ce soit es enceintes bas de gamme ou un casque très haut de gamme) : http://www.audiocheck.net/blindtests_index.php Ça force un peu la modestie en ce qui concerne les chiffres audiophiles...

La perception du volume est directement en rapport au type de compression utilisé. Pour preuve les publicités à la télévision qui ont un volume qui semble plus fort que le contenu alors que le CSA impose aux chaînes de ne pas changer le niveau. Les chaînes jouent sur la compression pour contourner la loi. http://www.csa.fr/Television/Autres-thematiques/L-intensite-sonore-de-la-television/Pourquoi-la-publicite-est-elle-trop-forte De toutes façons quoi que je te dise tu me prendra de haut et sera persuadé d'avoir raison.

Le 24 bits doit servir à améliorer la dynamique du signal s'il veut être utile et cela doit donc être fait dès l’échantillonnage de la source. Si c'est pour faire passer du 16 bits en faux 24 bits c'est inutile car la dynamique ne dépassera jamais 96dB après la conversion, il ne faut pas se leurrer. Le 24 bits est encore une fausse bonne idée pour palier au problème de marge : il suffit de faire correspondre le volume au gain de l'ampli de la sortie casque (en analogique donc) au lieu de décimer la valeur des échantillons à faible volume (mais quelle connerie...) et le 16 bits aura encore de l'avenir. "Le son est une vibration qui se propage sous forme d’ondes (dont la longueur est exprimée en Hertz)" Wow. "l’échantillonnage est la quantité d’informations que l’on récupère en une seconde" C'est la FREQUENCE d’échantillonnage. L'échantillonnage c'est la mesure de la valeur d'un signal de manière périodique, la mesure étant aussi précise que l'on peut. "l’échantillonnage est de 44,1 kHz, ce qui veut dire qu’on va réussir à capter 44 100 fois par seconde les vibrations et donc en théorie un son aigu d’une fréquence maximale de 44,1 kHz." En théorie non justement lol. "Chaque fréquence musicale est alors captée 192 000 fois par seconde" Le signal entier (=la somme de tous les signaux de chaque fréquence), pas chaque fréquence... "Sur la forme d’onde ci-dessous d’une musique, on peut voir le signal d’un appareil réglé avec un volume de sortie minimal. Malgré un échantillonnage en 16 bits, on peut voir une petite dizaine de nuances possibles sur les 65 536 théoriquement disponibles puisque le volume a été fortement diminué." On aurait bien voulu voir à quoi ressemble l'onde avec un volume plus élevé hein... "mais que le DAC (la puce qui convertir le signal numérique en signal analogique pour l’envoyer vers la sortie audio) est capable d’échantillonner la musique en 24 bits" Je rappelle qu'échantillonner permet de convertir le signal analogique vers un signal numérique mais le DAC saurait faire l'inverse aussi selon vous lol. Bon j'ai déjà les yeux qui piquent assez pour aller chercher d'autres perles.

Ben je sais pas, faudrait que je vienne chez toi, te faire entendre plusieurs versions de la même musique avec différents encodages et que tu me fasse un classement de la meilleure à la pire qualité mais c'est chiant, non ? Moi, je suis sur du matos de studio, convertisseur Focusrite, moniteurs Presonus Eris 8 et pièce d'écoute traitée et je serais difficilement capable, voire pas du tout, de faire une différence entre du mp3 320 et du wav 44.1. Alors dans un smartphone et une paire d'intras à 14,99€, j'y crois pas une seule seconde...

J'ai un ampli Atoll AM50, un dac home made sur du burr brown pcm1792, une paire d'enceinte home made d'occase équipé en Fostex, le tout pour 1000€. Je suis un menteur ?

Sinon, la solution c'est d'écouter de la bonne musique, ça passe même avec un son de merde... Blague à part, la fréquence d’échantillonnage n'a strictement rien à voir avec la fréquence d'onde. La fréquence d'onde c'est le nombre de fois que l'onde vibre par seconde, cela correspond aux notes de musique, plus la fréquence d'onde est élevée, plus la note est haute, l'oreille humaine est capable d'entendre de 30hz à 20khz, variable selon l'âge et la sensibilité de chacun. La fréquence d’échantillonnage est le résultat du traitement d'une onde analogique en une onde numérique et sa valeur correspond au nombre de fois que cette onde est "découpée" par secondes. Un peu comme une vidéo est le résultat de x photos par seconde. Quand on dit 44.1 khz, cela signifie que le signal d'origine est découpé 44 100 fois par seconde. Les différentes fréquences d'échantillonnage vont définir la définition su son; 41.1khz étant la référence, 48khz est un format adapté pour le son à l'image, une vidéo étant découpée en 24 images par secondes, cela permet une meilleure synchronisation, 88.2 est le double, et 96khz est le double pour le son à l'image. Il existe encore très peu de musique enregistrée à 192khz et comme une vidéo sera lue à 30 fps si le signal original est à 30 fps et ce même avec un écran capable de diffuser du 120fps, une musique ne sera lue qu'à 44.1khz si elle est enregistrée à 44.1khz, même si l'appareil qui la lit est capable de lire du 192khz. Maintenant, je défie quiconque de faire la différence entre un mp3 à 320kbs et un vaw avec un smartphone et les écouteurs livrés avec... Pour que la différence soit audible, encore faut-il avoir de très bonnes oreilles, il faut au mois 3 à 4000€ de matos entre convertisseur et haut-parleurs. Ceux qui prétendent entendre la différence sont des menteurs.

-Concernant le volume d écoute on ne peut pas comparer les résultats d'un ingénieur du son qui va naturellement pousser le volume pour percevoir la richesse du tintement d'une cymbale qui à été atténuée a cause de la compression, et le quidam qui va pousser son balladeur au maximum pour diverses raisons ( s'isoler du monde extérieur , ou mieux percevoir la musique par exemple ) de même je n'ai jamais assisté a un concert ou la musique ne dépassait pas 70db... pourtant la source n'est par definition pas compressé... -Concernant la puissance de sortie des casques ( qui vont de 4 a 400 ohms ) c'est un peu compliqué dans la mesure ou l'impédance du casque joue sur le volume -enfin on aura jamais de smartphone équipés de DAC de qualité avec pré ampli etc c'est incompatible avec l’encombrement et le cout du terminal , de même les capteur photos font de superbes photos pour mr tout le monde , mais ils sont a des années lumières de ce qui se fait en reflex , la encore l'espace minuscule du châssis interdit l'utilisation d'optiques lourdes coûteuses et encombrantes , qui pourraient pourtant permettre de travailler avec des capteurs plus grand et donc plus qualitatif. Par contre et en photo et en audio on peut obtenir un résultat tout a fait satisfaisant pour un usage "nomade" :) sachant qu'en mettant déja 300 ou 400€ dans un casque de "qualité" on peut déjà se faire plaisir y compris avec du mp3 a 320kbps. Dans mon cas j'utilise un note 4 , avec des XBA4 à armatures balancées , la difference entre du flac 24/192 ( téléchargé sur qobuz ) est du mp3 a 320kbps est perceptible ( pas phénoménale mais perceptible ) par contre elle disparaît complètement dans un environnement bruyant ( route , métro , avion , etc ) c'est a dire 75% du temps ...

Bon je vais chercher... Dans un commentaire au-dessus, ils ont cité un certain Paul Van Voller, mais c'est un fantôme sur Google. Je suis assez curieuse du détail des résultats en fait, parce que pour moi le mp3 faisait exactement l'inverse (c'est pas riche, mais ça donne déjà l'impression d'être fort)...

L'intérêt du suréchantillonnage est justement de limiter (voire supprimer dès 192kHz) les colorations produites par le filtre numérique et non de permettre la retranscription d'un signal à 96kHz tel que suggéré ici...

Justement quand tu fais "assez de traitement du signal", en lisant l'article tu ne dis pas que "l'article est plutôt bien fait". Ce que je critique c'est d'encenser un contenu sans même l'avoir parcouru.

C'est peut-être le commentaire le plus pertinent sur cet article. :D

Ce n'est justement pas ce qu'ils ont écrit... " Sur un CD audio, l’échantillonnage est de 44,1 kHz, ce qui veut dire qu’on va réussir à capter 44 100 fois par seconde les vibrations et donc en théorie un son aigu d’une fréquence maximale de 44,1 kHz. " Ce n'est possible ni en pratique, ni même en théorie d'échantillonner du 44,1khz à 44,1khz

Généralement on parle de signal échantillonné à 44,1KHz, ce qui en respectant le théorème de Shannon donne une fréquence max de ~22KHz, soit une fréquence supérieure à ce qu'un être humain normalement constitué peut entendre. Avec un filtre passe bas bien placé, on a pas de recouvrement et donc un son très proche de l'original.

Pour avoir un bon DAC et ce qui va avec, on fait clairement la différence avec du 24bits/96kHz. Au début on a l'impression qu'il n'y a pas de différence mais au bout d'un moment quand on écoute de la zic sur un truc plus standard on s'apperçoit qu'il manque quelque chose, c'est beaucoup moins fin aux oreilles. Par contre, avec un casque, même de bonne facture, j'ai jamais eu un aussi bon rendu qu'avec une bonne paire d'enceinte. Un autre point à ajouter, trouver de la musique qui ne sont pas "compressé" d'une autre façon. Aujourd'hui la musique est tripatouillé pour uniformiser la puissance sonore de tout les sons ce qui fatigue les oreilles et fait qu'on a mal au crâne après une heure de musique. Reste 2 solutions: Ripper ses vieux vinyl avec du bon matériel Acheter des ré-éditions comme Mobile Fidelity Sound Lab et éviter les sorties "version remasterisé" parce que là la compression sera au rendez vous et retour au problème d'écoute de musique plus d'une heure sans avoir mal aux oreilles et au crâne. Après, pour la musique plus récente, ben... on en écoute beaucoup moins et à petite dose et on ne va plus au cinéma non plus. Perso, la gestion du 24bits/96kHz sur smartphone m'évite surtout la fastidieuse opération de tout devoir convertir avant de le transférer. Le MP3 c'était bien dans les années 90 ou les HDD étaient de petite capacité et pour certain plus facile à transférer sur le net à l'époque du 56k

Tu cherches quoi ? un peu de reconnaissance ou te rendre intelligent ? J'ai lu en diagonale pas seulement les petites images, que j'ai à peine survolé. Mais j'ai fais assez de traitement du signal pour savoir qu'il y a eu un petit peu de recherche derrière sans avoir tout lu. Abstiens toi la prochaine fois que tu n'as rien d'intelligent à dire je te prie. (bien que ton silence risque d'être long.)

C'est bien de donner des liens, c'est mieux de les lire... Ce n'est pas la compression qui a un effet négatif sur l'ouïe mais le volume sonore : "L’auditeur est ainsi incité à augmenter le volume de son lecteur MP3. La gymnastique de l’oreille s’estompe, ce qui est d’autant plus aggravé par la proximité de l’oreille à l’écouteur. Dernièrement, le Ministère de la Santé a estimé que 6 à 25 % des jeunes de moins de 25 ans présentaient une perte auditive pathologique. Même si de nos jours, le volume des MP3 est limité à 100 décibels (dB), en réalité, le seuil de danger pour nos oreilles est de 85 dB qui correspond au bruit d’une tondeuse à gazon."

http://leblogdefrequenceslangues.fr/2013/07/01/le-saviez-vous-les-dangers-auditifs-du-mp3/ http://mobile.lemonde.fr/technologies/article/2008/08/29/le-mp3-mutile-le-son-et-l-audition_1088364_651865.html http://www.bladi.info/threads/mp3-rend-sourd.18306/ Et je n'ai pas dit que la seule conséquence de la compression mp3 était la suppression des aigus. C'est juste celle qui a un effet négatif sur notre audition.

Si c'etait la seule bêtise... En échantillonant à 44,1 khz on ne peut pas échantillonner un signal dont la fréquence est de 44.1khz...

Un super reportage TV sur France 5/Arte d'il y a quelques années.

Tu l'as pas lu mais t'arrive à dire tout ça grâce aux images c'est ça ? X)

Source ? L'etude m'interesserait beaucoup

Oui, mais ça reste quand même assez marginal, et les constructeurs ne l'utilisent pas du tout comme argument de vente, à l'inverse des qualités d'écran ou des capteurs photos. Le choix de Samsung pour son prochain devrait changer la donne et forcer les autres constructeurs à plus communiquer dessus !

C'est uniquement une théorie qui a defaut d'avoir été démontrée comme fausse n'a pas été démontrée comme vraie. Sinon le mp3 ne se contente pas de détruire les aigus pour compresser les sons. Bref un beau tissu de n'importe quoi ce commentaire

"On a eu le droit à la course aux PPI, aux Mégapixels, pourquoi pas une course aux dB ?" Cette course existe déjà sur les smartphones, bien que méconnue du grand public (et de la plupart des testeurs de smartphones...). Du moins, les smartphones se sont drastiquement améliorés sur les sorties casque, ces 3 dernières années. Avec par exemple une séparation stéréo bien mieux maîtrisée, des volumes de sortie bien meilleurs (surtout chez HTC), un niveau de bruit qui diminue d'année en année, des applications de musique de plus en plus avancées (notamment chez Samsung)... L'année prochaine, Samsung va peut-être même sortir le Galaxy S7 avec un DAC capable de lire du 36 bits à 384 kHz, et un niveau de bruit extrêmement faible. C'est déjà pas mal !

Bon honnêtement je n'ai pas lu, mais l'article semble plutôt bien fait. Il y a de la recherche, et du contenu. Enfin un vrai article, ça faisait longtemps. ça mérite un page chargée sans AdBlock (14 pubs tout de même !, enfin 70 avec les mouchards sur Ghostery...) ! Je lirai sûrement demain.

"ondes (dont la longueur est exprimée en Hertz)" La longueur d'onde est exprimée en mètres, la fréquence est exprimée en Hertz. Il faut choisir, sinon c'est faux ! "Finalement, les smartphones compatibles 24 bits / 192 kHz comme le nouveau HTC A9 ou le Marshall London mais également 24 bits / 96 kHz sur certains smartphones Xperia de Sony" Sinon, le DAC du Galaxy S3 prenait déjà en charge la musique en 24 bits / 96 khz, en 2012, ou encore le HTC One M7 début 2013... Et depuis le Snapdragon 800 (fin 2013 - Note 3 par exemple), tous les smartphones haut de gamme supportent nativement la musique en 24 bits / 192 kHz. Je ne comprends vraiment pas pourquoi on parle de nouveauté alors que la seule nouveauté est le marketing à propos de cette musique HD !

La plupart du temps les test ne parle que du haut parleur du téléphone et des marque comme htc s'en sort très bien mais qui n'a jamais été dérangé par une personne qui pousse son tél à fond sans se soucier de son entourage??!! Les constructeur selon moi devrais plutot limité la puissance des haut parleur externe et améliorer la sortie casque pour ma part j'écoute beaucoup de musique et pour moi le casque reste le moyen le plus qualitatif donc un examen minutieux de la sortie casque, de la technologie interne etc, et logiciel ne peut que me ravir j'ai hate de vous lire pour voire vos impression sur le smarthphone de marshall, super article un grand merçi a toi Vincent.

Ah ok, je pensais avoir fait une erreur quelque part ^^

Malheureusement, si avoir du son de qualité est très agréable, la majorité du grand public ne constate jamais la différence, et écoute sa musique sur YouTube avec les haut-parleurs intégrés de leur téléphone… Ce genre de produit resteront destinés à des marchés de niche, aujourd'hui. Je serais vraiment très surpris si un constructeur grand public arrivait à lancer un flagship avec ce genre de point dans les arguments principaux.

Oui je veux ...

Ça ne change rien au problème, le mp3 supprime les aigus, même à 320 kbps, ça empêche l'oreille d'appréhender le volume sonore correctement et l'abîme donc plus vite. L'aac est une meilleure alternative à 320kbps. Les codecs sans pertes ou le musepack sont bien meilleurs pour la pérennité de notre audition.

C'était plus pour compléter, la confusion est faite a plusieurs reprises dans l'article

Je suis agréablement surpris du contenu, par rapport à l'ignoble titre de l'article. Pas de parti ridicule pris, sur cet eternal combat du mec qui dit que ca sert a rien, face au mec qui achète des vinyls, et qui trouve ca normal.

Euh... Où ai-je dit que la longueur d'onde était exprimée en hertz ? Nulle part... La longueur d'onde λ dépend de la célérité c du son et de la fréquence f par le rapport c/f. Enfin, c'est de l'acoustique quoi.

Sauf qu'une longueur d'onde c'est en mètre, et non en Hertz, les Hertz c'est pour la fréquence.

Article très intéressant. Je penses qu'il faut accorder une place un peu plus importante au son dans ce monde où la vue reigne en maître mais qu'il va falloir "former" le public à maîtriser un peu plus ses esgourdes... Petite question concernant les casques à transmission osseuse (type Batband sur Kikstarter) quelqu'un à essayé ? Pourrait-on avoir un article là dessus car ça risque d'être amené à se démocratiser...

@Vincent Sergère Il me semble que des acousticiens ont relevé que le manque d'informations du mp3 par rapport à un FLAC du fait de la compression pousseraient les utilisateurs à pousser le volume pour tenter "de retrouver" ces informations perdues. De cause à effet, je laisse deviner ce que peut induire l'écoute prolongée à plus haut volume... Pour répondre à la question : oui, très clairement c'est un manque dans les tests du site actuellement. J'aimerais connaître la puissance de la sortie casque des smartphones testés, tout comme la puissance des haut-parleurs (mesurée à 1m de distance par exemple), de la même manière que l'on mesure la luminosité max des écrans ou la température des couleurs. Pour moi, un smartphone est un produit multimédia complet, qui se doit d'être au top sur plusieurs aspect : photo, vidéo, audio et jeux vidéos (même si je n'attache guère d'importance à cette dernière). Les tests en général mettent l'accent énormément sur la qualité des écrans et les performances du CPU et du GPU (pratique pour les jeux vidéos ou le visionnage de vidéos), ainsi que sur la qualité des capteurs photos. De ce fait, les constructeurs se focalisent essentiellement sur ces aspects, et délaissent bien trop la partie audio de leur mobile. Insister dans les tests sur cet aspect forceraient les constructeurs à mieux équiper leurs smartphones. On a eu le droit à la course aux PPI, aux Mégapixels, pourquoi pas une course aux dB ? Au moins là on aura des smartphones réellement complets avec de vrais DAC, ampli, sortie casque et suite logicielle, de la même manière que les utilisateurs exigent aujourd'hui des capteurs photos de plus en plus performant et une application photo avec mode manuel.

L'audio c'est la base sur un smartphone, étant un grand amateur, je ne peux qu'apprécier les smartphones avec une bonne qualité audio! Et les htc sont des bons élèves sur ce point !

Oui tout à fait. Le DAC est bien plus important que le fichier audio. Je possède un Fiio E18 et on entend clairement la différence entre le E18 et la sortie casque de base du téléphone, et ce sur un même fichier.

Franchement, je ne pense pas. A moins qu'un panel en double aveugle entende une différence nette sur du matériel a un prix raisonnable (telephone a 400€max, écouteurs a 100€ max), le grand public me parait hors cible. Un homme normal utilise son matos pour écouter de la musique. Un audiophile utilise la musique pour écouter son matos. C'est une toute petite niche.

Non non, on parle bel et bien de "longueur d'onde" pour une onde sonore.

Pour moi la qualité du DAC importe plus. Pour avoir testé un même mp3 avec un même casque sur mon Nexus 4 et sur un iRiver H340 (vrai baladeur audiophile), le rendu n'a rien à voir. Quand j'aurais mon LG G4, j’achèterai un DAC externe (genre Fiio Q1) pour obtenir une écoute qui me convient. Mais lire de l'audio HD, c'est presque un effet placebo chez moi dont je peux me passer.

Bon, j'ai rien lu parce que on s'en fout un peu de votre dossier du dimanche après midi, mais ouais, il faut de l'audio HD, sinon c'est de la merde dans les oreilles.

Je trouve que la question n'est posée qu'à moitié: on sait depuis longtemps qu'il faut aussi un bon casque pour pouvoir profiter d'un bon son.

En vrai, même le 128 kbps convient à une majorité de personnes.

Y'a mp3 et mp3, le 320 kbps convient à la majorité des personnes.

Le mp3 est une horreur, on le sait depuis 15 ans, quand le monde libre voulait le remplacer par du mpc (musepack).

Avec votre Momentum, ça m'étonnerait, en effet.

Le terme "longueur d'onde" ne me semble pas très approprié, on utilise ce terme pour la lumière et est exprimée en nm (ou plus lorsqu'on se rapproche des micro ondes), la fréquence est en s-1 (l'inverse d'une seconde)

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.