Cloud vs local : deux approches de l’IA

L’intelligence artificielle et le « machine learning » font partie intégrante de nos smartphones, avec deux approches toutefois assez différentes. L’une consiste à privilégier le nuage pour analyser les données : votre smartphone envoie les informations sur des serveurs, et elles sont traitées en ligne, avant d’être restituées dans vos applications.

L’exemple le plus parlant est Google Photos. De la simple reconnaissance de visages ou d’objets, à la création automatique de panoramas, d’images animées, de films, et même la retouche automatisée, le cloud Google fait le travail à votre place, mais aussi à celle de votre smartphone. Lors de vos vacances, vous avez peut-être vu pulluler les notifications : nouvelle image stylisée, nouveau panorama, nouvel album, pas un jour ne se passe sans que Google Photos ait du nouveau contenu à vous proposer.

On voit aisément les avantages et les inconvénients de cette méthode : d’un côté, le nuage évite au processeur de votre smartphone des traitements gourmands en utilisation du processeur, et donc en énergie. De l’autre, un robot sur un serveur distant vient d’analyser toutes vos photos personnelles, et même si on fait relativement confiance à Google pour ne pas en faire n’importe quoi, on peut raisonnablement trouver ça un peu intrusif.

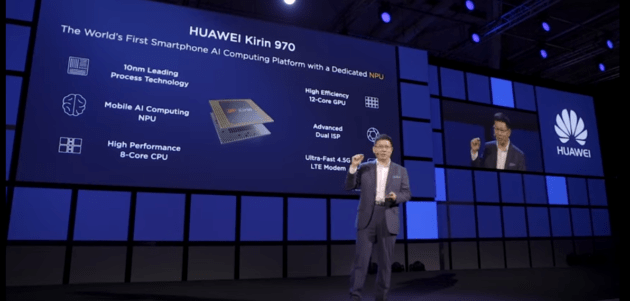

De l’autre côté il y a l’approche locale qui consiste à réaliser tous les traitements sur l’appareil, et qui peut garantir une meilleure confidentialité. Mais c’est également beaucoup d’opérations réalisés par une puce qui n’a pas été spécifiquement pensée pour ça, et qui a sans doute mieux à faire. Huawei est le premier à dégainer un SoC équipé d’une puce dédiée aux tâches d’intelligence artificielle, le Kirin 970, que l’on trouvera à l’intérieur du Huawei Mate 10, dévoilé le 16 octobre prochain.

Kirin 970 : plus efficace et rapide pour les réseaux neuronaux

L’unité, que Huawei nomme NPU (pour compléter le CPU et le GPU) permet de déployer une vitesse de calcul de 1,92 TFLOPs, sur des nombres en virgule flottante 16 bits, visiblement suffisants pour les opérations de machine learning. En clair, Huawei affirme que le NPU du Kirin 970 est capable de traiter des réseaux neuronaux avec une une rapidité jusqu’à 25 fois supérieure à celle du CPU pour la même tâche, tout en étant 50 fois plus efficace. Pour appuyer ses chiffres, le constructeur utilise un benchmark où le FPU serait capable de traiter 2 000 images par minute.

En plus de permettre un traitement local, et pas trop énergivore de données sans passer par le cloud, l’intégration d’une puce dédiée à l’intelligence artificielle peut aussi apporter des bénéfices certains sur la reconnaissance vocale, la réalité augmentée, ou la photographie, des domaines où soulager le CPU de ces tâches au profit d’une puce dédiée peut avoir un impact significatif sur la sauvegarde des ressources, et donc de l’autonomie.

Pour une intelligence artificielle hybride

La rentrée 2017 pourrait d’ailleurs être chargée en annonces similaires d’autres constructeurs, à commencer par Apple qui met nettement en avant son « machine learning » local et son désir de sauvegarder la confidentialité des données des utilisateurs. Bloomberg avait révélé en mai dernier qu’une puce similaire était en préparation du côté de Cupertino, sans que l’on sache précisément si elle serait prête pour la sortie du nouvel iPhone X qui sera annoncé le 12 septembre.

Du côté de Huawei on attend encore d’en savoir davantage sur les usages concrets de ce FPU. Le géant chinois a tout de même dévoilé une vision : « IA mobile = IA locale + IA dans le nuage ». Un mélange des deux approches qui semble tomber sous le sens : utiliser le cloud là où il est nécessaire pour appuyer un apprentissage réalisé essentiellement sur l’appareil ménagerait idéalement la batterie du smartphone, comme la confidentialité des données de son utilisateur.

Pour ne rater aucun bon plan, rejoignez notre nouveau channel WhatsApp Frandroid Bons Plans, garanti sans spam !

Donc on devrais se contenter de ce qu'on a et arrêter le progrès ? Avec se genre de raisonnement vous n'auriez même pas pu poster ce genre de commentaire sur l'ordinateur qui à était inventer avant même qu'on lui imagine une utilité.

2 fois ici

Revoilà l'autre crétin des Alpes qui fait sa fouine !

ok t'as raison on te la fait pas à toi t'es trop malin...reste dans l'ignorance c'est plus confortable (pour l'instant). Mais t’étonnes pas le jour ou tu perdras ton boulot parce qu'une IA le fera mieux que toi ^^

Pierre, zeston, peut être que l IA te fera comprendre qu’un seul compte suffit pour répondre sur un forum

Ça va être utile pour toi l ´IA Mouhaha

Beaucoup de blabla qui démontre que ce bullshit marketing fonctionne. Merci

ce qu'on appelle IA dans les jeux videos est la plupart du temps à des années lumières de la "vraie" IA.

désolé mais reseau neuronal ca veut dire quelque chose. renseignes toi avant de parler de ce que tu ne connais pas...ça permet de résoudre des problèmes qu'on ne sait pas résoudre de façon algorithmique, en copiant le fonctionnement du cerveau (pour simplifier). quand tu fais une recherche d'image dans google il n'y a pas quelqu'un qui a ecrit un algorithme qui sait reconnaitre une voiture, un chat, etc mais un reseau de neurones qui a appris à les reconnaitre en s'entrainant sur BEAUCOUP d'images pour lesquelles on lui a fourni la reponse (ex cette image contient un chat, celle ci non). ca permet de resoudre un tres grand nombre de problemes different avec le meme type de reseau neuronal, il suffit de changer les données en entrée et les reponses attendues en sortie et le reseau sait se reconfigurer

Les réseaux neuronaux sont basés sur des calculs matriciels. Chaque coefficient de pondération de la matrice comporte une partie d'une information diffuse dans tout le réseau neuronal (dans toute la matrice si tu préfères). Non, un réseau neuronal, ce n'est pas que pour en mettre plein la vue...

l'algo et la prod font parti de l'"IA". ce sont des programmes à la base... bref de toute façon on est déjà dedans et on y va de plus en plus, on ne pourra y couper

"Nous nous sommes émerveillés de cette magnificence dès la venue au monde de l'IA" Morpheus

Non, ca s'apelle des algo et de la prog. On donne juste un nom plus geek,kikoo et plus marketing : l'AI. C'est comme quand on nous sort du "réseau neuronal". Ca veut rien dire mais tout le monde adore.

le traffic et l'influence est analysé en permanence. ne crois pas que c'est un guguss qui fait ça derrière son écran...

Euh c'est quoi l'ai pour le metro? Ca reste des scripts tout bêtes oui, jvois pas où t'a vu un truc intelligent la dedans?

l'AI on l'a au quotidien (voiture, autoroute, métro, smartphone, facebooks et compagnies..... ) impossible de s'en passer maintenant. C'est l'avenir, désolé on ne pourra passer outre...

idem de l'AI en fait.

Pour ce qu'on s'en branle, des jeux....

Toi t'as pas joué à Vietcong... Pistolet avec silencieux pour faire furtif... Une colonne de vietcong avance, tu descends celui de devant au silencieux, il tombe... Mais comme les autres n'ont pas entendu le coup de feu, ils continuent à avancer comme si le gars de devant n'était pas tombé... Ca c'est de l'IA!

Il y a une IA dans gta... Elle est d'ailleurs bien médiocre à certains niveau... Si ca peut aider à l'améliorer...

Il faut grandir et arrêter de jouer comme les petits enfants. On parle d'IA ! C'est de l'intelligence artificielle pas de la GameBoy... lol

Ce n'est pas judicieux de considérer que c'est le CPU seul qui va traiter les données dans un appareil sans puce dédiée IA... Sur une image ou de la vidéo, ce seront plutôt l'ISP et le GPU qui feront le boulot... Sur un son, on fera plutôt bosser le DSP...

L'art d'inventer un besoin que l'on imaginait pas avant de le découvrir sans l'avoir recherché et en même temps c'est pas réellement la première fois... C'est la base de fonctionnement des sondages d'opinion : répondre positivement, par ou ou par non, à une question alors qu'une seconde avant, tu n'avais pas idée de la problématique. La modernité c'est formidable.

Moi ça me gonfle un peu qu'ils mettent une puce dédiée pour un truc dont je ne me sers pas encore. J'espère que la conso de la puce est nulle quand on désactive l'IA...

Oui, ma phrase était bizarrement tournée, je parlais bien sûr de 1,92 TFLOPs en 16 bits, j'ai reformulé. :)

C'est en 16bits!! En 32 on passe à 0,96 tflops donc à peu près moitié moins que la ps4, faut pas pousser mémé dans les orties non plus, t'a vu la consommation d'une ps4?

Ouais mais tu peux pas jouer à gta 5 sur cette puce... et ça, ça n'a pas de prix !

1.92 tflop ! Plus qu'une PS4

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et ses partenaires.

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.

Gérer mes choix