La question de l’éthique est au centre des problématiques de l’intelligence artificielle. À ce titre, les usages militaires de l’IA sont controversés, puisqu’il s’agit souvent de blesser ou tuer des humains en utilisant des machines.

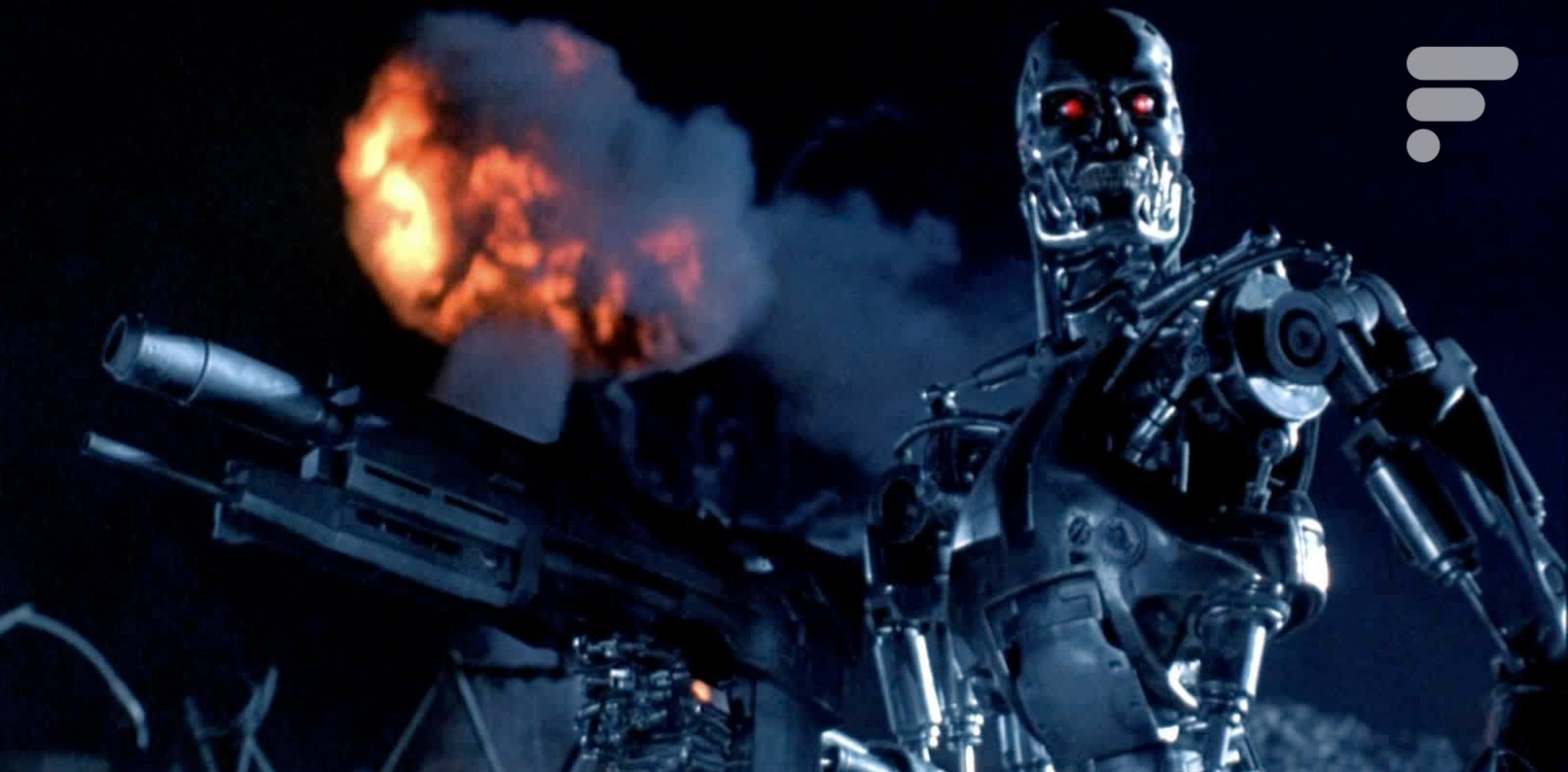

Pas (encore) de Terminator à l’horizon

Un accord publié aujourd’hui à l’occasion de l’International Joint Conference on Artificial Intelligence (conférence sur l’IA) à Stockholm tend à rassurer quant à d’éventuelles utilisations militaires de l’intelligence artificielle.

En effet, il consiste en un engagement à ne pas développer la moindre « arme létale autonome ». Celui-ci a été signé par plusieurs géants de l’intelligence artificielle. Parmi les signataires, on peut noter Elon Musk, fantasque PDG de Tesla et de SpaceX, ou encore les trois cofondateurs de Google DeepMind, dont l’IA a notamment battu le champion du monde de jeu de Go et qui s’attaque aujourd’hui aux jeux vidéo.

Le but est d’éviter d’avoir des machines qui décident sans intervention humaine de cibler et d’éliminer un être humain. L’IA aura cependant sa place pour accompagner les militaires dans leurs missions.

Le monde est-il sauf ? Pas forcément. Un grand nombre d’acteurs du milieu de l’IA n’ont pas signé cet engagement, comme Facebook ou Apple, pour ne citer qu’eux.

Pour aller plus loin

Faut-il avoir peur de l’intelligence artificielle ?

Rendez-vous un mercredi sur deux sur Twitch, de 18h à 20h, pour suivre en direct l’émission SURVOLTÉS produite par Frandroid. Voiture électrique, vélo électrique, avis d’expert, jeux ou bien témoignages, il y en a pour tous les goûts !

Ils ont pas la B20 j'crois hihihi

Sauf si elle s'appelle Ultron ou Skynet. :p

"Alors on est en train de créé un truc pour tous vous tuez mais n'ayez pas peur tout est sous controle!"

Ta raison car il y a des vagues d'idiots des fois sur Frandroid de temps en temps 😂

Si c'est bixby l'ia on est plus que mal barré 😂

oui enfin si c'est une vraie IA au sens où on veut nous la "vendre" aujourd'hui, c'est pas le programmateur qui décidera mais elle même par son "auto apprentissage", du coup si elle pense que c'est bon pour ce qu'elle est censée faire elle s'y mettra peut être à tuer des gens. Ou alors on nous racontes nawak depuis le début et ces IA ne sont pas vraiment des IA mais juste des programmes un peu plus avancé que les autres dans leur analyse mais c'est tout.

Pendant ce temps là, les armes nucléaires sont aux mains des intelligences humaines que sont Trump, Poutine et Kim Jong Un. À la limite, je serais peut être plus rassuré si c'était une IA qui prenait la décision, plutôt que ces trois là...

La veille de l'abandon des projets de Google, on lit encore des appels aux devs... Ils changent d'avis comme Trump. Et vu le temps qu'ils ont gardé "dont be evil" juste par cynisme, c'est peut-être déjà fait. À demanteler d'urgence !

S'ils le faisaient, ils nous le diraient bien entendu ;-) PS : c'est de l'ironie (je précise pour certains)

Ou l'excellent jeu Horizon Zero Dawn, qui raconte la meilleure histoire de ce genre.

Ou l'excellent jeu Horizon Zero Dawn, qui raconte la meilleure histoire de ce genre.

Non car on sait très bien que Google le fera quand même.

C'est censé rassurer certains ?

Bordel ça sent trop la fin à la Skynet/Matrix

On peut, peut-être en acheter sur Gearbest ?

C est la même chose qu'ils promettent dans terminator avec skynet 😒

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et ses partenaires.

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.

Gérer mes choix