Si Google reste maître sur le domaine de la recherche en ligne en retournant généralement de bons résultats, du côté de YouTube, les choses sont bien différentes. En effet, la liste des vidéos recommandées par la plateforme est souvent sujette à critiques. La fondation Mozilla estime que ces dernières peuvent être dangereuses pour les internautes en retournant « des conspirations sur la pandémie » ou de la « désinformation politique ».

Face à l’opacité du fonctionnement de l’algorithme et des dangers potentiels que Mozilla estime « bien réels », la fondation lance aujourd’hui une nouvelle extension pour son navigateur Mozilla Firefox ainsi que pour Google Chrome.

Mozilla prend le problème à cœur en expliquant que l’intelligence artificielle procédant à ces recommandations compte pour 70 % de l’ensemble des lectures de la plateforme. Et pour mémoire, YouTube, c’est tout de même 2 milliards d’utilisateurs par mois. En d’autres termes, l’algorithme de YouTube influence considérablement les internautes et il serait urgent de le rendre plus efficace.

Comment fonctionne l’extension ?

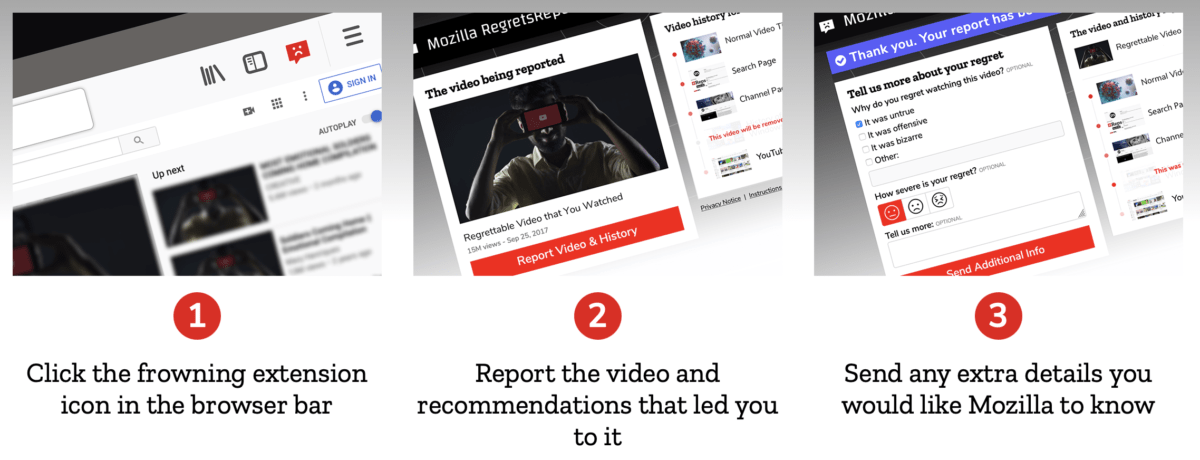

Baptisée RegretsReporter, cette extension permet de rapporter à Mozilla les recommandations que l’on juge peu pertinentes, voire dérangeantes lorsque l’on suit de manière passive les suggestions de lecture de YouTube. Pour cela, il suffit de cliquer sur le bouton de l’extension. D’emblée, la vidéo en cours et l’historique de la lecture sont automatiquement extraits. Ces éléments permettront à Mozilla de mieux comprendre le cheminement. Il est ensuite possible de préciser la raison pour laquelle vous rapportez ladite vidéo (fake news, contenu inapproprié ou offensif…).

Notons que par souci de confidentialité, il est également possible d’enlever plusieurs éléments de son historique de visionnage. Aussi, il est précisé que les données collectées ne sont pas associées à un compte YouTube, mais disposent d’un identifiant unique généré de manière automatique.

Au travers de cette étude, Mozilla tentera de déterminer par quel biais des vidéos racistes, homophobes ou de type conspirationniste sont recommandées par la plateforme et dans quelle proportion. Pour cette raison, l’internaute doit continuer d’utiliser YouTube normalement.

Ce n’est pas la première fois que Mozilla pointe le service de vidéo de Google du doigt. En août 2019, la fondation a soulevé le problème afin d’ouvrir un dialogue avec les ingénieurs de la société tout en détaillant la manière dont une intelligence artificielle peut potentiellement manipuler un internaute. Le mois suivant, Mozilla a d’ailleurs interrogé la mère d’un adolescent s’étant radicalisé en ligne et notamment via la filiale d’Alphabet.

- Téléchargez RegretsReporter pour Mozilla Firefox

- Téléchargez RegretsReporter pour Google Chrome

Envie de retrouver les meilleurs articles de Frandroid sur Google News ? Vous pouvez suivre Frandroid sur Google News en un clic.

truc espion inutile lorsque l'on aime le conspirationnisme , hé hé 🤪

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et ses partenaires.

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.

Gérer mes choix