Envie d’avoir votre propre ChatGPT en local ? Avant tout, pas de jugement, les rêves de chacun sont uniques. Mais, il y a une nouvelle solution. Nvidia vient de lancer pour un outil pour ceux d’entre nous qui aiment tester de l’IA sans quitter le confort de son PC : Chat With RTX. C’est une application qui transforme votre PC en un serveur d’intelligence artificielle, à condition d’avoir un GPU Nvidia sous le capot, évidemment.

Imaginez pouvoir discuter avec votre ordi et lui demander de fouiller dans vos documents ou de résumer une vidéo YouTube sans avoir à lever le petit doigt. C’est précisément ce que propose Chat with RTX. Nvidia appelle ça une démo, mais ne vous y trompez pas, c’est déjà assez puissant et certainement utile.

Mistral ou LLaMA 2 au choix

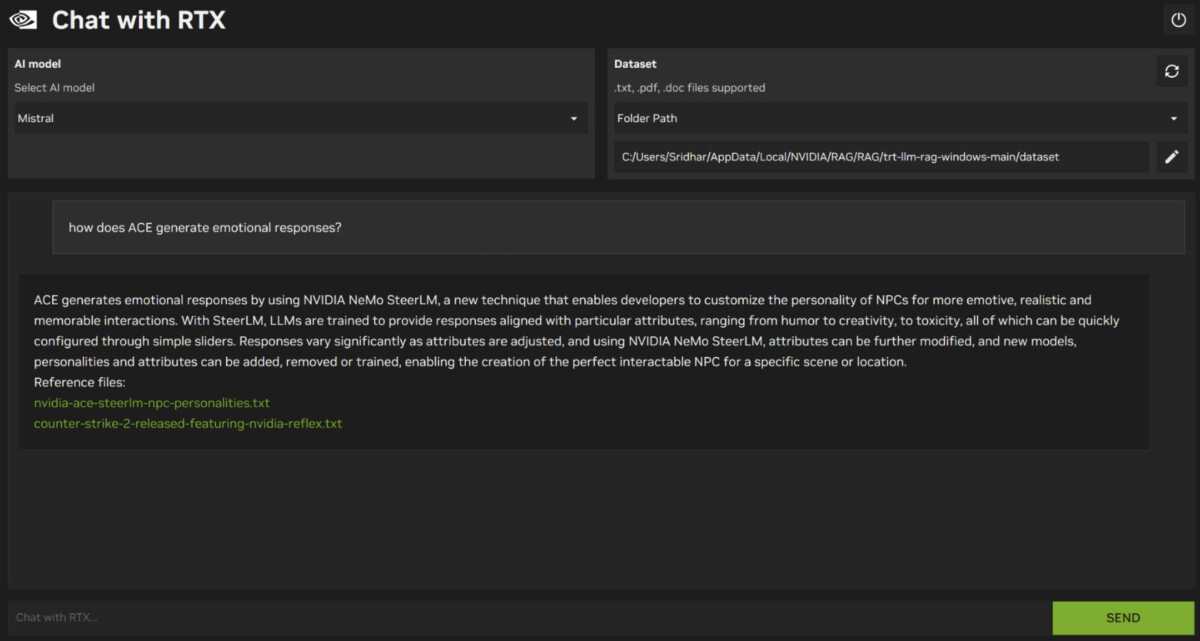

Alors, ce n’est pas GPT qui est utilisé comme LLM. Ici, on parle de ChatGPT pour que ça plus facilement compréhensible. Les utilisateurs ont le choix entre Mistral et LLaMA 2 (Meta) comme modèles de langage (LLM) pour animer leur Chat With RTX. Ce sont deux LLM open-source.

Pour aller plus loin

C’est quoi un LLM ? Comment fonctionnent les moteurs de ChatGPT, Gemini et autres ?

Après avoir sélectionné un dossier de documents à analyser, vous pourrez interroger le chatbot qui extraira les informations pertinentes. D’ailleurs, ça marche bien en langue française.

Par exemple, si vous demandez à Chat With RTX de trouver les détails de votre vol dans un dossier de vacances, il vous fournira les informations sous forme textuelle et reliera les documents sources pour un accès rapide. De même, il peut résumer un planning d’activités en PDF ou extraire des informations de vidéos YouTube, simplement en insérant le lien dans l’application.

Comme nous l’avons dit au début, Chat With RTX nécessite un GPU Nvidia sur votre ordinateur. Le chatbot est compatible avec tous les modèles des séries RTX 30 et RTX 40 disposant d’au moins 8 Go de VRAM. Les autres conditions requises pour l’installer sont d’avoir Windows 11, au moins 16 Go de RAM et la version 535.11 ou supérieure des pilotes de votre carte graphique.

L’application elle-même est un peu gourmande : 40 Go d’espace de stockage et 3 Go de RAM. Mais le jeu en vaut la chandelle, surtout si vous aimez avoir le contrôle de vos données. Tout se passe localement sur votre machine, donc adieu les soucis de confidentialité liés au cloud. Vous pouvez télécharger l’application ici.

Pour aller plus loin

Quelle carte graphique choisir ? Les meilleurs GPU de chez Nvidia et AMD en 2025

Téléchargez notre application Android et iOS ! Vous pourrez y lire nos articles, dossiers, et regarder nos dernières vidéos YouTube.

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et ses partenaires.

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.

Gérer mes choix