Mistral, Llama 2… le chatbot en local ChatRTX (anciennement Chat with RTX) de Nvidia intègre depuis quelques mois déjà plusieurs modèles de langage, également nommés LLM. Cette fois-ci, c’est au tour de la famille Gemma de Google d’arriver sur ChatRTX, le ChatGPT de Nvidia, avec des versions ouvertes de Gemini.

Pour aller plus loin

C’est quoi un LLM ? Comment fonctionnent les moteurs de ChatGPT, Gemini et autres ?

Faire fonctionner l’IA de Google sur son PC avec sa carte graphique Nvidia

C’est la promesse du fabricant de cartes graphiques : faire fonctionner des mini-ChatGPT en local sur son ordinateur. Attention : il ne s’agit pas là du modèle GPT 3.5 d’OpenAI, mais d’autres LLM conçus par d’autres entreprises. Nvidia a annoncé intégrer désormais Gemma, un ensemble de modèles conçu par Google pour fonctionner en local sur des ordinateurs.

Google indiquait récemment que Gemma faisait partie des meilleurs modèles ouverts par rapport à sa taille. Deux tailles sont disponibles : Gemma 2B et Gemma 7B, en fonction du nombre de leurs paramètres. Gemma 7B est naturellement plus puissant que Gemma 2B. À noter que les conditions d’utilisation permettent une utilisation commerciale des textes générés avec Gemma. Autre nouveauté dans ChatRTX annoncée par Nvidia : la possibilité d’utiliser la voix pour discuter avec le chatbot.

Comment utiliser ChatRTX

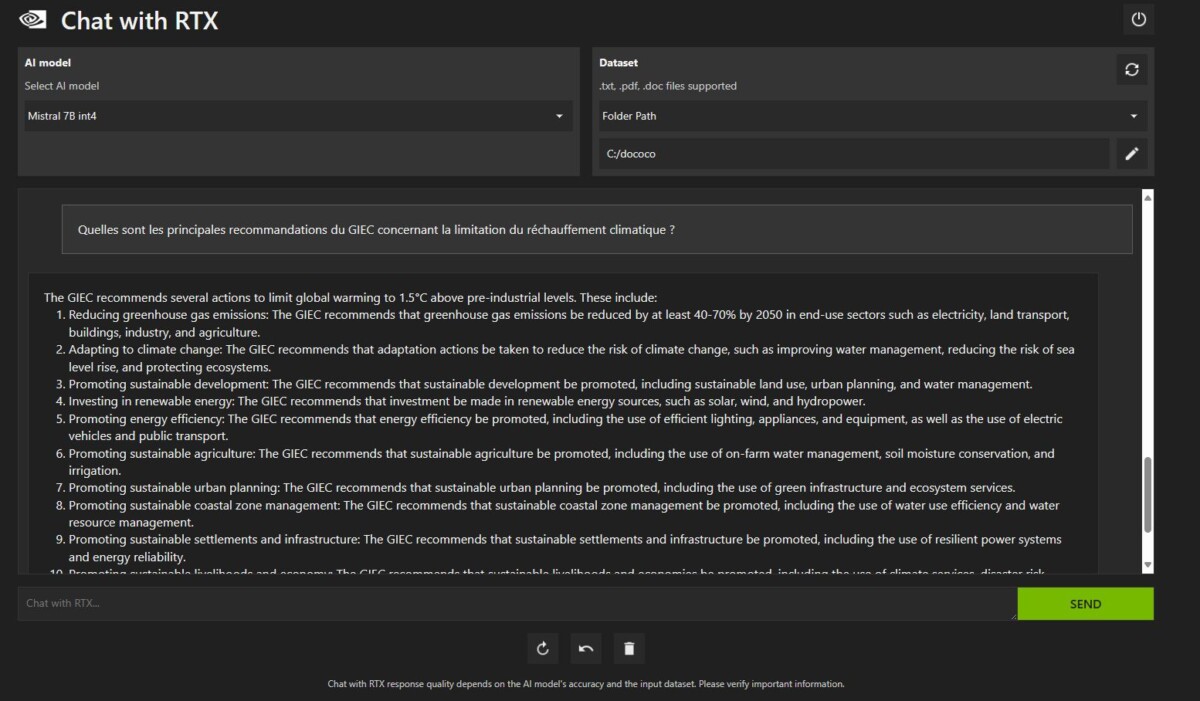

Pour ce faire, n’importe quelle carte Nvidia ne suffira pas. Comptez au minimum un GPU RTX des séries 30 ou 40 et de 8 Go de VRAM pour pouvoir utiliser ChatRTX. En fait, le logiciel crée un serveur local pour le chatbot auquel on peut se connecter via son navigateur. Ce serveur peut accéder à Internet, ce qui permet d’alimenter les requêtes avec des données collectées sur Internet, en plus des données qu’on peut lui donner depuis sa machine. De quoi obtenir des résumés et des réponses à des questions sur ses propres données.

L’inconvénient de cette solution, c’est donc qu’il faut un PC suffisamment puissant pour cela, en plus de télécharger des modèles lourds. L’avantage toutefois, c’est de ne pas dépendre d’un service en ligne : sécurité des données garantie ici. Autre avantage important de ChatRTX : pas besoin de beaucoup s’y connaître en informatique pour lancer les divers LLM, contrairement à nombre d’autres logiciels. L’interface indique quels sont les modèles les plus susceptibles de vous aider en fonction des données que vous voulez analyser. Enfin, il y a même une fonction de reconnaissance d’images, qui permet d’entraîner le modèle CLIP d’OpenAI à reconnaître des images depuis son ordinateur.

Retrouvez un résumé du meilleur de l’actu tech tous les matins sur WhatsApp, c’est notre nouveau canal de discussion Frandroid que vous pouvez rejoindre dès maintenant !

Ce contenu est bloqué car vous n'avez pas accepté les cookies et autres traceurs. Ce contenu est fourni par Disqus.

Pour pouvoir le visualiser, vous devez accepter l'usage étant opéré par Disqus avec vos données qui pourront être utilisées pour les finalités suivantes : vous permettre de visualiser et de partager des contenus avec des médias sociaux, favoriser le développement et l'amélioration des produits d'Humanoid et de ses partenaires, vous afficher des publicités personnalisées par rapport à votre profil et activité, vous définir un profil publicitaire personnalisé, mesurer la performance des publicités et du contenu de ce site et mesurer l'audience de ce site (en savoir plus)

En cliquant sur « J’accepte tout », vous consentez aux finalités susmentionnées pour l’ensemble des cookies et autres traceurs déposés par Humanoid et ses partenaires.

Vous gardez la possibilité de retirer votre consentement à tout moment. Pour plus d’informations, nous vous invitons à prendre connaissance de notre Politique cookies.

Gérer mes choix